Tuhaf ama, Geçen ay Maslak’ta bir toplantıda, bir güvenlik yöneticisi bana şunu dedi: “Biz browser tarafını bayağı sıkı tuttuk, AI endpoint’lerini de kestik. Ama ekip yine yolunu buluyor.” İşin aslı şu ki, mesele artık tarayıcıda bitmiyor (ki bu çoğu kişinin gözünden kaçıyor). Gölge yapay zekâ yeni bir şekle büründü; bu kez veri dışarı kaçmıyor, model cihazın içine yerleşiyor.

Ben de açık konuşayım — bu konuyu ilk duyduğumda “tamam, birkaç meraklı geliştirici lokal model çalıştırıyordur” diye geçiştirdim. Sonra 2024 sonbaharında kendi dizüstümde küçük bir kod modeli test ederken fark ettim işte gerçeği: Wi‑Fi kapalıyken bile her şey akıyor, üstelik kullanıcı tarafında hiçbir ağ izi kalmıyor. Güzel mi? Hız açısından valla evet. Kötü mü? Tam da o noktada başlıyor sorun — güvenlik ekibi için bayağı görünmez hâle geliyor.

Kısa bir not düşeyim buraya.

Neden herkes şimdi yerel modele kayıyor?

İki yıl önce orta halli bir iş laptopunda işe yarar bir büyük dil modeli çalıştırmak… nasıl desem, biraz hobi projesi gibiydi. Hatta dürüst olayım, 2023’te Kadıköy’de bir startup ofisinde buna kalkışan ekiplerin çoğu ya RAM’e yeniliyordu ya da sabır testine giriyordu — ikisi de pek iç açıcı değildi. Şimdi tablo değişti. Ciddi fark var. Apple Silicon’lar, yüksek bellekli dizüstüler ve verimli kuantizasyon araçları işi bayağı kolaylaştırdı; kolaylaştırdı derken şaka değil, gerçekten uçurumdan farklı bir yerdeyiz artık.

Bak şimdi, Burada üç şey aynı anda patladı diyebilirim: birinçisi donanım güçlendi, ikincisi modeller küçülüp hızlandı, üçüncüsü de dağıtım acayip kolaylaştı (ki bu çoğu kişinin gözünden kaçıyor). Mesela bugün biri terminale tek satır yazıp modeli indiriyor, sonra lokal sohbet başlıyor; hani eskiden kurumsal yazılım kurulumu için onay zinciri olurdu ya — işte burada o zincir çoğu zaman yok, kimse sormadan devam ediyor.

Çok konuştum, örnekle göstereyim.

Donanım eşiği düştü

64 GB birleşik belleğe sahip bir MacBook Pro’da 70B sınıfı kuantize modellerin kullanılabilir hızlarda çalışabildiğini görüyoruz. “Kullanılabilir” kelimesini özellikle söylüyorum — — itiraz edebilirsiniz tabi — üretim hattındaki her iş için uygun değil bu, yanlış anlaşılmasın. Ama özetleme, kod inceleme, taslak çıkarma gibi görevlerde fena değil, hatta bazen buluttaki pahalı servisten daha pratik çıkıyor; bu gerçeği de görmezden gelemeyiz.

Bir şey dikkatimi çekti: Buna karşılık maliyet ve kontrol dengesini yeniden düşünmek gerekiyor. Çünkü cihaz üzerinde çalışan modelin faturası görünmez oluyor ama risk ortadan kalkmıyor. Sadece adres değiştiriyor.

Kuantizasyon ana akım oldu

Kuantizasyonu mutfak benzetmesiyle anlatayım. Büyük tencereyi alıp içindekileri daha küçük kavanozlara bölmek gibi düşünün; aynı yemek var ama taşınması kolaylaşıyor. Model boyutu düşüyor, bellek ihtiyacı azalıyor, hız artıyor; kaliteyse bazı görevlerde idare eder seviyede kalıyor. İdare eder. Mucize değil. Qwen3-TTS’te Ses Klonlama Sınırı Kalkıyor:.qvoice Dönemi yazımızda bu konuya da değinmiştik.

Geçen yıl Ankara’da bir fintech ekibinde bunu test eden bir arkadaşım anlattı: kod yardımcısı olarak lokal modeli açmışlar, çünkü dış servise müşteri verisi göndermek istememişler — haklı kaygı, not düşelim. Üç hafta sonunda mühendisler memnun kalmış ama compliance ekibi rahatsız olmuştu. Neden? Hangi modelin hangi veriyle beslendiğini kimse düzgün kayıt altına almamıştı (ciddiyim). Hayal kırıklığı tam da buydu işte: hız kazanırken denetim kaybedilmişti.

CISO’nün asıl kör noktası nerede?

Asıl mesele veri sızıntısı değil artık — ya da en azından tek mesele o değil. Yerel çıkarımda risk daha çok bütünlük, kaynak doğruluğu ve uyum tarafına kayıyor. Yani veri dışarı çıkmasa bile yanlış karar içeride alınabiliyor. Sessiz ama can sıkıcı bir problem bu, üstelik kimse fark etmiyor hemen.

Yerelde çalışan yapay zekâda en tehlikeli şey görünür olmaması değil sadece; kurumun önü “zararsız kişisel araç” sanmasıdır.

DLP’nın ekranında hiçbir şey görünmeyince güvenlik ekipleri rahatladı sanılıyor. Tam tersi oluyor aslında. Kontrol edemediğin şeyi raporlayamazsın da. Bu yüzden sorun teknik olduğu kadar organizasyonel de — ikisini birbirinden ayırarak çözmek mümkün değil.

Bütünlük riski: Kod ve karar zehirlenmesi

Bir geliştirici community-tuned bir model indirip iç auth akışını veya ödeme mantığını ona gösterdiğinde ne oluyor? Peki neden? Çünkü model dışarı konuşmuyor olabilir ama önerdiği kod parçaları şirket standardıyla çelişebilir, gizli desenleri sızdırabilir ya da hatalı mimariyi normalleştirerek ekibin aklına kazıyabilir — bunu fark etmek de çoğu zaman aylar alıyor. Butterfly CSS: 2026’da Dikkat Çeken Hafif Bir Seçenek yazımızda bu konuya da değinmiştik.

Benzer durumu geçen mart ayında İzmir’de küçük bir SaaS firmasının kod gözden geçirme sürecinde gördüm. Ekip üyelerinden biri yerel modeli “yardımcı” diye kullanıyordu; iki gün sonra repoya giren birkaç snippet’in lisans uyumluluğu bile tartışmalı çıktı. Neyse, uzatmayalım — hız kazanırken denetim kaybedilmişti, hepsi bu. Hormuz Gerilimi Petrolü Zıplattı: Piyasada Neler Oluyor? yazımızda bu konuya da değinmiştik. Bu konuyla ilgili Same churn sinyali, iki farklı doğru cevap yazımıza da göz atmanızı tavsiye ederim. Daha fazla bilgi için PDF Dünyasında Bir Nefes: Ücretsiz ve Limitsiz Araçlar yazımıza bakabilirsiniz.

Köken ve izlenebilirlik problemi

Kurumlar genelde “bu çıktı nereden geldi?” sorusuna cevap arar. Bulut servislerinde en azından audit log vardır; lokal kullanımda işe çoğu zaman yoktur ya da eksiktir (inanın bana). Bir doküman özeti hangi model sürümüyle üretildi? Hangi parametrelerle? Kim indirdi? Cevaplar havada kalıyor.

| Risk alanı | Bulut AI | Lokal AI |

|---|---|---|

| DLP görünürlüğü | Yüksek / orta | Düşük |

| Ağ logları | Genelde mevcut | Bazen yok |

| Sürüm takibi | Daha kolay | Zorlayıcı |

| Veri sızıntısı riski | Ağ üzerinden net görülür | Cihaz içinde gizli kalabilir |

| Bütünlük riski | Model sağlayıcısına bağlı | Kurum içinde yayılır |

Neden klasik güvenlik araçları yetmiyor?

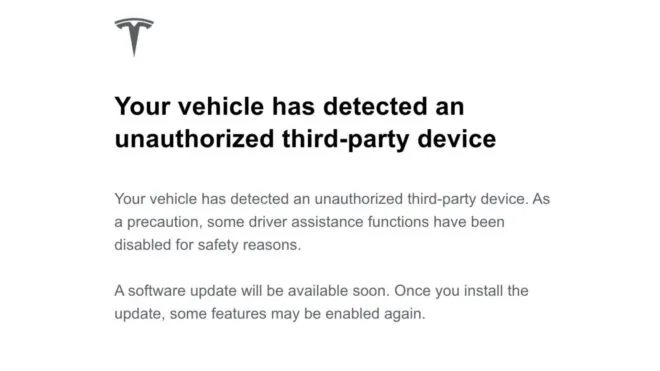

CASB’yi sıkılaştırdınız diyelim. Proxy’den geçmeyen trafik zaten oyundan çıkıyor gibi görünebilir… fakat yerel modelde trafik yok ki! Kullanıcı internete gitmeden de prompt verebiliyor, dosya analiz ettirebiliyor, metin ürettirebiliyor. Bu kadar basit, bu kadar korkutucu.

Buna biraz eski usul masa telefonu örneği gibi bakıyorum ben: santralden geçen aramayı dinlersiniz ama iki kişinin odada fısıldaşmasını duyamazsınız. Lokal AI da tam böyle davranıyor — fısıldaşıyor, kayıt yok, iz yok.

DLP neden kör kalıyor?

DLP sistemleri çoğunlukla ağ sınırında veya kurumsal uygulama katmanında güçlüdür. Fakat prompt ile çıktı aynı cihazın içinde dönüyorsa neyi yakalayacaksınız? Ekran görüntüsü mü? Dosya erişimi mi? Her şeyi gerçek zamanlı çözmek mümkün değil tabii ki, bunu kimse beklemiyor zaten.

E tabi burada uç nokta algılama ve yanit araçlarının rolü büyüyor ama onlar da tek başına yetmez. Uygulama beyaz listesi, cihaz politikası. Yazılım envanteri olmadan koça boşluğu kapatamazsınız — birini atlarsanız diğeri anlamsız kalıyor.

Kurumlar ne yapmalı?

Lafı gevelemeden söyleyeyim: lokal yapay zekâyı yasaklamak kısa vadede rahatlatır ama uzun vadede pek işlemiyor. İnsanlar yine kullanır. Sadece gölgede kullanırlar ki asıl sorun da zaten o.

- Lokal model çalıştırmayı tamamen yasaklamak yerine izinli kullanım politikası oluşturun.

- Cihaz envanterinde GPU/CPU kapasitesini ve yüklü AI araçlarını takıp edin.

- Sensitive data için “yerel kullanım uygun mu?” karar ağacı hazırlayın.

- Model indirme kaynaklarını sınırlayın; rastgele GitHub/Model Hub çekmelerini serbest bırakmayın. (bu kritik)

- Ağ dışı kullanım için loglama ve kullanıcı beyaninı birlikte değerlendirin.

- Kritik iş akışlarında insan onayı şartını koruyun; modele teslim etmeyin her şeyi!

Küçük startup ile enterprise arasında fark ne?

Küçük startup’ta mesele genelde pratikliktir: ekip hızlı olsun ister, kontrol listesi kısa tutulur, insanlar birbirine güvenir — belki fazla. Enterprise tarafta işe regülasyon baskısı var; finansal kayıtlar, sağlık verileri ya da müşteri sözleşmeleri devreye girince oyun sertleşiyor, bambaşka bir boyuta taşınıyor.

Küçük ekipler için çözüm daha hafif olabilir: onaylı araç listesi, basit eğitim ve birkaç net kural başlangıç için yeterli. Kurumsal tarafta işe model yaşam döngüsü yönetimi şart — hangi model geldi, kim kullandı, hangi veriyle denedi… bunların hepsi kayıt altında olmalı, istisnasız.

Sessizce büyüyen BYOM dönemi — “Bring Your Own Model” ne anlama geliyor?

Evet, kavram biraz esprili duruyor. Ama gerçekliği sert. Çalışan kendi seçtiği modeli getiriyor veya indiriyor (en azından benim deneyimim böyle). Şirket ağı dışında kullanıyor olabilir; bazen masum başlıyor — not özetlemek için — bazen de doğrudan kod inceleme veya müşteri iletişimine uzanıyor, fark etmeden.

Şahsen, Bir de şu var: model iyi çalıştıkça kullanıcı önü bırakmak istemiyor. Doğal, anlaşılır, insan psikolojisi bu. İşte tam orada kontrol kaygan zemine dönüşüyor ve görünmez alışkanlıkların güvenlik borcu sessizce büyüyor. Maalesef.

Peki ne ölçmeli?

# Basit kontrol listesi

1) Hangi cihazlarda lokal AI araçları var?

2) Hangi modeller indirilmiş?

3) Kimler can alıcı veriyle deneme yaptı?

4) Log tutma mekanizması var mı?

5) İhlal durumunda müdahale planı hazır mı?

Kuruma özgü politika yoksa yerel AI yasağı kağıt üstünde kalır; izin varsa da denetim olmadan kaosa döner.

Sıkça Sorulan Sorular

(h2)

Lokal yapay zekâ neden güvenlik riski sayılıyor?

Doğrusu, Çünkü ağ trafiği oluşturmadan çalışabiliyor ve klasik DLP/CASB kontrollerinin dışında kalabiliyor.

Bu da kurumun neyin işlendiğini görmesini zorlaştırıyor.

En büyük risk veri sızıntısından çok görünmez kullanım ve yanlış karar üretimi oluyor.

CISO yerel AI kullanımını tamamen engellemeli mi?

Tamamen engellemek çoğu şirkette işe yaramaz.

Daha doğru yaklaşım izinli kullanım politikası koymak,

kritik veri türlerini sınırlamak ve kayıt tutmak ölür.

Kısacası yasaktan çok yönetişim lazım.

DLP sistemleri lokal modelleri tespit edebilir mi?

Sadece kısmen.

Dosya erişimi,

uç nokta davranışı veya şüpheli uygulama kurulumu üzerinden ipucu verebilirler ama doğrudan prompt/çıktıyı genelde göremezler.

Bu yüzden tek başına yeterli değiller.

Küçük şirketler neyle başlamalı?

Önce hangi araçların kullanıldığını bulun.

Sonra basit bir izin listesi,

veri sınıflandırması ve çalışan eğitimi ekleyin.

Başlangıçta ağır platformlara gerek olmayabilir;

net kurallar genelde daha hızlı sonuç verir.

Kullandığım referans çerçevesi ve yakın okuma önerileri

(önce iç bağlantılar)

Eğer kurum içinde yapay zekâ ajanlarının nasıl başka kör noktalara dönüştüğünü merak ediyorsanız AI Ajanları: Kurumların Sessiz Güvenlik Kör Noktası yazısına göz atabilirsiniz; oradaki tablo bu konuya bayağı iyi oturuyor.

Bir başka faydalı parça da Linux’un Yapay Zekâ Kod Kuralı: Copilot Serbest, Slop Yasak. Orada kod üretiminin kurumsal disiplinle nasıl dengelenebileceğine dair net sinyaller var.

Bence bu konuyu anlamanın en iyi yolu pratikten geçiyor; teoriyi herkes anlatır ama saha başka şeydir.

Mesela geçen ay Nişantaşı’nda görüştüğüm bir ürün ekibi,

yerel modeli sadece toplantı notu çıkarmak için açtığını söyledi;

iki hafta sonra satış tekliflerini de ona emanet etmişlerdi…

küçük başlayan alışkanlıkların nasıl büyüdüğünü canlı canlı gördüm.

Kaynaklar ve İleri Okuma (önce resmî kaynaklar)

- Microsoft Security Documentation

- OWASP Top 10 for LLM Applications

- llama.cpp GitHub Sayfası

Bu içerik işinize yaradı mı?

Benzer içerikleri kaçırmamak için beni sosyal medyada takip edin.