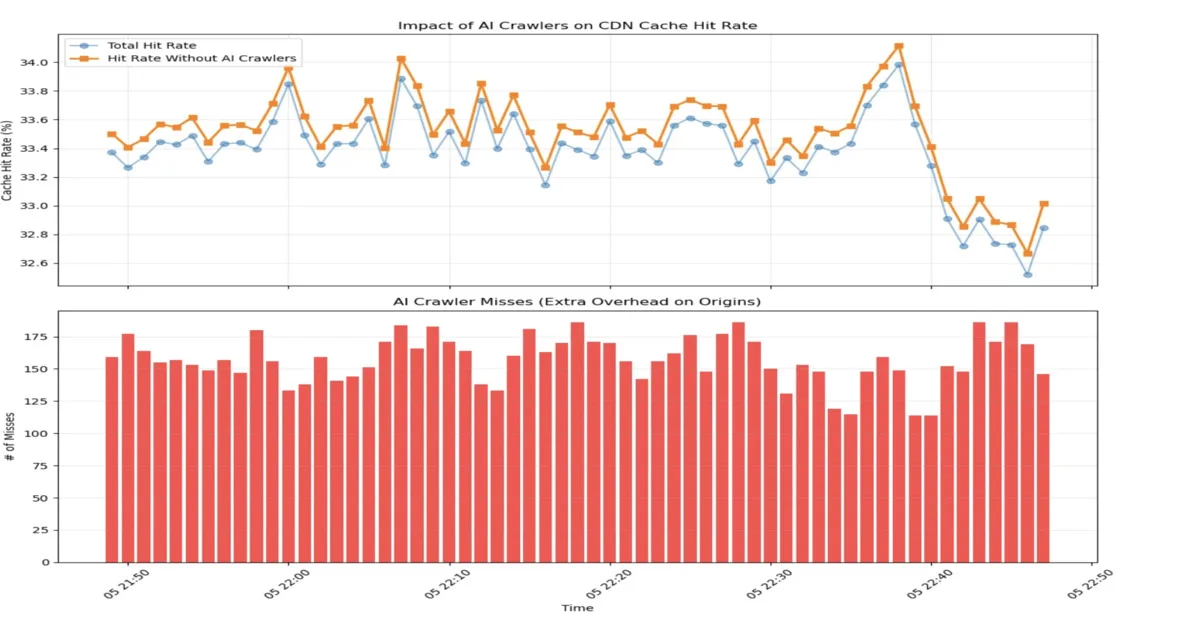

Geçen ay İstanbul’da bir kurumsal içerik projesinde tam da bunu konuştuk. Cache neden bir anda “iyi çocuk” olmaktan çıkıyor? Trafik normal görünüyor, CDN tarafı keyifli çalışıyor —. Arka planda AI botları sayfaları kazıdıkça kazıyor. İşin rengi değişiyor. Cloudflare ile ETH Zürich’in işaret ettiği mesele de kabaca bu zaten: Geleneksel cache mantığı insan trafiği için bayağı iyi çalışıyor; fakat yapay zekâ destekli tarayıcılar. Veri toplayıcılar devreye girince tablo biraz ters yüz oluyor, hani beklediğiniz gibi değil.

Açık konuşayım. Bu tartışma sadece “biraz daha trafik geldi” meselesi değil. Daha çok şu soruyu sorduruyor: Aynı kaynağa hem gerçek kullanıcılar hem de model besleyen sistemler aynı şekilde mi davranmalı? Bence asıl kırılma noktası tam burada. Çünkü klasik cache algoritmaları isteğin niyetini bilmiyor — insan mı geldi, bot mu geldi, RAG motoru mu tarıyor… hepsi aynı sıraya diziliyor. Hâliyle performansın tadı kaçabiliyor.

İşte tam da bu noktada devreye giriyor.

Bir de şu var. 2024 sonbaharında Berlin’de küçük bir SaaS ekibiyle konuşurken benzer bir dert duymuştum. Adamların API’si değil. Dokümantasyon sitesi AI crawler’larla öyle bir yüklenmişti ki hit oranı düşmüş, origin tarafında gereksiz maliyet patlamıştı. “Cache var ya” dedikleri şeyin ne kadar hassas bir denge üzerinde durduğunu orada tekrar gördüm. Bu haber o yüzden bana teorik gelmedi; bayağı günlük operasyon kokuyor.

Neden klasik cache artık tek başına yetmiyor?

Bak şimdi, Bakın şimdi… Eskiden cache demek çoğu zaman basit bir hız oyunu gibiydi. Aynı içerik tekrar tekrar isteniyorsa ara katmanda tutarsın, origin’i rahatlatırsın, kullanıcıya cevabı hızlı verirsin. Temel mantık hâlâ geçerli — ama AI çağında talep profili değişti. Botlar sadece ana sayfayı yoklamıyor; uzun kuyruktaki içerikleri topluyor, parça parça veri çekiyor ve bunu düzensiz saatlerde yapıyor. Düzensiz derken gerçekten kaotik, yani öngörülü bir ritim yok.

Buradaki sorun şu: Klasik cache politikaları genelde frekansa bakar. Çok istenen obje tutulur, az istenen atılır. Güzel fikir. Ama AI botlarının davranışı dümdüz değil — bir içerik sabah yoğun istenirken öğleden sonra sessizleşebiliyor, sonra başka bir model eğitimi veya yeniden indeksleme turunda tekrar kapıyı çalıyorlar. Talep dalga dalga geliyor… hani deniz gibi değil, daha çok bozuk asfalt üzerinde giden bir araba gibi.

Cloudflare ve ETH Zürich’in çizdiği resim tam burada anlam kazanıyor. Artık “tek cache bir düşüneyim… havuzu” yerine farklı amaçlara hizmet eden katmanlar düşünmek gerekiyor. İnsan kullanıcının gördüğü hızlı sayfa ile makine tüketimine ayrılan veri aynı kovaya atılınca sistem nefes nefese kalabiliyor.

AI trafiği neden farklı davranıyor?

Çünkü bu trafik meraklı bir ziyaretçi gibi değil, sünger gibi davranıyor. Bir insan kullanıcı on sayfa gezer gider; bot işe yüzlerce URL’yi otomatik sıraya koyabilir. Üstelik bazıları görünür olmayan yerleri yokluyor, bazıları güncellenmiş sürümü almak için tekrar geliyor. Durmuyor yani.

Kendi test laboratuvarımda geçen yıl küçük bir reverse proxy kurulumu denemiştim; loglarda tekil IP sayısı yüksek değildi. Istek deseni garipti. Normalde sıcak kalması gereken — kendi adıma konuşayım — nesneler sıklıkla yer değiştiriyordu çünkü botların erişim ritmi insan ritmine hiç benzemiyordu, gerçekten hiç. İşte tam o an anladım: Cache’i sadece hız katmanı diye görmek artık biraz naif kalıyor.

Önerilen yaklaşım ne? Tek kutu yerine akıllı ayrım

Cevap aslında çok sade görünüyor. Uygulaması işe epey uğraştırıcı. Ayrıştırılmış cache katmanları,. Insan kullanıcıya hızlı yanit veren katman başka olsun, AI crawler veya veri toplama işlerine hizmet eden katman başka olsun. Böylece her iş yükü kendi davranışına göre yönetilir — birbirini boğmadan.

Bence, Bunu mutfak örneğiyle anlatayım. Evdeki her şeyi tek çekmeceye tıkmak yerine bıçakları ayrı yere koymak gibi düşünün. İlk bakışta ekstra uğraş gibi durur, hatta gereksiz bile görünebilir. Ama ortalık karışmayınca iş hızlanıyor. Cache tarafında da durum böyle; karma iş yükü tek havuzda tutulunca kısa vadede pratik görünür ama orta vadede performans. Maliyet sızı dürtüyor. Kaçınılmaz olarak.

Bir dakika — bununla bitmedi. Bu konuyla ilgili Veritabanına Fazla Bağlanmak: Neden Daha Yavaşlatır? yazımıza da göz atmanızı tavsiye ederim.

Yani, ETH Zürich’in önerilerinde adaptif algoritmalar da önemli yer tutuyor. Yani sistem sabit kurallarla değil, gözlemle öğrenerek hareket ediyor olabilir: Hangi kaynak daha sıcak kalmalı? Hangi veri kümesi botlara ayrı servis edilmeli? Hangi isteğe farklı TTL uygulanmalı? Kağıt üstünde basit sorular ama büyük ölçekte bayağı kritik hâle geliyor — inanın.

| Yaklaşım | Ne sağlar? | Zayıf yani |

|---|---|---|

| Tek cache havuzu | Sade işletim modeli | Ağır bot trafiğinde çabuk kirlenir |

| Ayrılmış cache katmanları | Daha iyi izolasyon ve kontrol | Karmaşıklığı artırır |

| Adaptif algoritmalar | Trafiğe göre dinamik karar verir | Tuning işi ister |

| Pay-per-crawl modeli | Maliyet dengesini kurabilir | Ticarî ve etik tartışma çıkarır |

Küçük startup için ne ifade ediyor?

Küçük ekiplerde ilk refleks genelde “Şimdilik idare eder” ölür. Haklılar da; kaynak sınırlıdır, herkes ürün yetiştirmeye çalışıyordur. Tamam, anlıyorum. Ama işin aslı şu ki erken aşamada bile bot trafiğini görmezden gelmek ileride fatura olarak geri dönüyor. Fatura da düşünduğunuzdan daha hızlı geliyor bazen.

Startup seviyesindeyseniz önce kaba ayrımlar yeterli olabilir: Botlara ayrı rate limit koymak, statik içerikte agresif CDN kullanmak. Sık güncellenen verileri kısa TTL ile tutmak mesela işe yarar çözümlerden biri (şaşırtıcı ama gerçek). Büyük mimarı kurmadan önce bu temel temizlikler ciddi fark yaratıyor — şaşırdım açıkçası, ne kadar basit şeylerin ne kadar iş yaptığına.

Kurum tarafında durum neden daha sert?

Büyük yapılarda problem sadece performans değil; uyumluluk da devreye giriyor, maliyet planlaması da devreye giriyor… hatta bazen hukuk ekibi bile masaya geliyor (evet, doğru duydunuz). Çünkü AI crawler’ların hangi içeriği ne kadar tükettiği konusu lisanslama ve erişim politikalarına dayanabiliyor. Daha fazla bilgi için Screen Studio’ya Alternatif Arayanlar İçin 5 Sağlam Seçenek yazımıza bakabilirsiniz. Bu konuyla ilgili Oppo’dan lüks saat hamlesi: Watch X3 Mini geliyor yazımıza da göz atmanızı tavsiye ederim.

Kurum ölçeğinde ayrı cache tier’ları neredeyse zorunlu hâle geliyor diye düşünüyorum. Bir yanda müşteri portalı var, öte yanda arama indeksleyiciler, onun yaninda LLM sağlayıcılarının veri toplama talepleri var. Hepsini aynı kasada tutarsanız darboğaz kaçınılmaz — bu kadar basit.

“Cache optimize etmeu artık yalnızca hız işi değil; kimin ne kadar veri tükettiğini ayırabilme işi.”

Sadece teknik çözüm yetmez: Ticarî model de değişiyor

Neyse uzatmayalım… Burada beni en çok düşündüren kısım (belki yanilıyorum ama) pay-per-crawl fikri oldu. İlk duyduğunuzda biraz garip geliyor, hatta “bu ne saçmalık” diyebilirsiniz. Ama mantığını kurcalayınca anlaşılır hâle geliyor: AI servisleri belirli verileri düzenli biçimde tüketiyorsa bunun maliyeti sıfır olmak zorunda mı? Bence değil.

Böyle modeller iki şeyi birlikte çözüyor olabilir. Birinçisi altyapı maliyeti baskısını azaltmak, ikincisi işe kaynak sahibi ile tüketici arasında adil bir ilişki kurmak. Tabii bu hemen güllük gülistanlık olacak demiyorum — bot ekonomisi serttir, taraflar fiyatlandırma konusunda kolay kolay anlaşmaz; hele açık web kültürü söz konusuysa tartışma iyice kızışır. Bunu yaşayacağız zaten. Prime Day İndirimlerinde Akıllı Alışveriş: Kaçırmama Rehberi yazımızda da bu konuya değinmiştik. İran, Hürmüz’de Bitcoin ile Geçiş Ücreti Mi Toplayacak? yazımızda da bu konuya değinmiştik.

Peki pay-per-crawl her yerde çalışır mı?

Bana sorarsanız hayır, her yerde çalışmaz. Mesela açık erişimli bilgi sitelerinde fazla sert modeller ters tepebilir; insanlar içeriğin kapanmasından hoşlanmıyor, bu kesin. Ama ticarî dokümantasyon, kurumsal bilgi tabanı ya da büyük medya arşivlerinde makul olabilir.

- Avantajı: Maliyeti paylaşmayı sağlar.

- Avantajı: Aşırı taramayı frenleyebilir.

- Eksi tarafı: Uygulaması politik olarak zor olabilir.

- Eksi tarafı: Yanlış fiyatlama olursa iyi niyeti zedeler.

Mühendislerin önünde duran pratik yol haritası

| Aşama | Neyi izlemeli? | Neden önemli? |

|---|---|---|

| Trafik sınıflandırma | User-agent değil davranış paterni (istek sikliği, yol derinliği) | Sahte ayrimlari azaltır |

| Katman ayrımı | Anlık kullanıcı / crawler / batch işler | Sistemi dengede tutar |

| TTL iyileştirmeu | Sabit süre yerine içerik türüne göre ayar | Sicagi sicagina data korunur |

{

"cache_policy": {

"human_tier": { "ttl_seconds": 300 },

"crawler_tier": { "ttl_seconds": 30 },

"adaptive_eviction": true,

"origin_protection": true

}

}Tabloya bakınca “bu çok kaba taslak” diyebilirsiniz — haklısınız. Ama gerçek hayatta işler zaten tertemiz gitmiyor. En doğrusu önce gözlemlemek, sonra ufak ufak ayarlamak. Log incelemesi, hit ratio takibi, origin latency grafikleri… bunlar olmadan yapılan tüm konuşmalar biraz fal bakmaya benziyor. Ciddi söylüyorum.

Bende bıraktığı izlenim ne oldu?

Açık söyleyeyim: Bu yaklaşım beni heyecanlandırdı ama tam pişmiş bulmadım. Güzel fikir, hatta yer yer kaçınılmaz görünüyor — yine de standartlaşması zaman alacak. Bu konuda en büyük hayal kırıklığı sektörün hâlâ AI trafiğini net tanımlayamaması olabilir. Bot deyince herkesin aklına başka şey geliyor; kimi kötü niyetli kazıyıcı görüyor, kimi meşru indeksleyici görüyor. Ortak dil yok henüz.

Ben geçen mart ayında Ankara’da yaptığım kısa bir danışmanlık görüşmesinde buna benzer karışıklık yaşamıştım. Ekip “trafik artışı” diyordu, ama aslında artan şey raporlama scriptleri idi (yanlış duymadınız). Eğer metrikleri doğru ayırmazsanız yanlış problemi çözmeye kalkarsınız — sonra bütün hafta boşuna efor gider. Çok üzücü bir his, o ayrı.

Sıkça Sorulan Sorular

AI-driven cache optimization nedir?

AI tarafından üretilen ya da yönlendirilen trafik desenlerine göre cache politikasını uyarlamaktır. Amaç hem insan kullanıcıyı hızlandırmak hem de crawler yükünü sistemi bozmayacak şekilde yönetmektir.

Neden klasik CDN cache’i yeterli olmuyor?

Çünkü klasik yapı genelde istek sıklığına bakar. Oysa AI botları düzensiz,derin ve yoğun taramalar yapabilir: Bu durumda sıcak veri yanlış yerde tutulabilir ya da origin sunucu gereksiz yorulur.

Küçük şirketler ne yapmalı?

İlk adım trafiği ayırmaktır:rate limit,TTL optimizasyonu ve temel log analizi çoğu zaman yeterlidir. Tam kapsamlı adaptif sistem kurmadan önce basit önlemler ciddi fayda verir.

Pay-per-crawl modeli işe yarar mı?

Bazı senaryolarda evet; özellikle büyük veri tüketimi olan platformlarda işe yarayabilir. Ama her sektörde uygun değildir çünkü erişim özgürlüğü ve ticarî beklentiler arasında gerilim yaratabilir.

Kaynaklar ve İleri Okuma

Bu içerik işinize yaradı mı?

Benzer içerikleri kaçırmamak için beni sosyal medyada takip edin.