Dün akşam saatlerinde OpenAI yeni modelini sessizce duyurdu. GPT-5.5. İsim kısmında çok oyalanmamışlar belli ki, ama içerik tarafı boş değil; “en akıllı modelimiz, daha hızlı, daha yetenekli, kod yazmada. Veri analizinde fena değil” diyorlar. Ben de hemen baktım, birkaç testten geçirdim, sonra Azure OpenAI tarafında ne var ne yok diye kurcalamaya başladım.

Şunu en baştan söyleyeyim: Bu yazıyı “mükemmel bir model geldi, hepiniz koşun” diye yazmayacağım. Çünkü iş öyle değil. Gerçek biraz ortada duruyor, hatta bazen insanı hafif ters köşeye bile yatırıyor.

GPT-5.5 Neyi Değiştiriyor?

Garip gelecek ama, Lafı gevelemeden anlatayım. GPT-5.5, GPT-5 ailesinin bir ara sürümü gibi duruyor; yani yeni bir nesil değil, daha çok eldeki mimariyi toparlayıp biraz parlatan bir güncelleme (ben de ilk duyduğumda şaşırmıştım). OpenAI’ın duyurusuna bakınca üç yerde iyileşme var: karmaşık kod işlerinde başarı oranı, araçlar arasında gezinirken bağlamı kaybetmeme hâli, bir de uzun araştırma zincirlerinde tutarlılık. Kısacası, vitrin değişmemiş ama iç tarafta el değmiş.

Kendi deneyimimden konuşuyorum, Ben modeli ilk kurcaladığımda bir Azure Bicep şablonunda tam 340 satırlık bir infrastructure-as-code dosyasını refactor ettirdim. GPT-5 aynı işi 3 ayrı turda toparlayabilmişti, biraz uğraştırmıştı açıkçası; 5.5 işe tek seferde bitirdi, üstüne de küçük bir “bu parametre deprecated oldu, şunu önereyim mi?” notu düştü. Şaşırdım, evet. Ama… işte orada küçük bir ama var.

Aynı modele bu kez müşteride kullandığımız gerçek üretim ortamı Kubernetes YAML’ını verdim; hacim de az buz değildi (ConfigMap’ler, Secret referansları, Helm değerleri birbirine girmiş haldeydi), model bir noktada bağlamı kaçırdı ve “bu alan tanımsız” diye uyardı — halbuki tanımlıydı, sadece başka bir dosyanin içindeydi. Yani token penceresi büyümüş olabilir ama her şeyi çözdü demek fazla iyimser ölür. Bunu kenara not edin.

Hız Tarafında Durum Ne?

Bilmem anlatabiliyor muyum, Hız tarafında ölçtüklerim şöyle çıktı: Orta karmaşıklıkta bir prompt’ta (1200 token input) GPT-5 ortalama 4.2 saniyede ilk token üretirken, 5.5 bunu 2.7 saniyeye indirmiş. Streaming tarafında da yaklaşık %30 civarı daha iyi gidiyor. Bu kadar mı? Değil tabii; pratikte sohbet ederken hissediyorsunuz bunu.

İşte tam da bu noktada devreye giriyor.

Bir bakıma, bilmem anlatabiliyor muyum, Batch işleme yapıyorsanız ya da günlük 50 bin çağrı atıyorsanız, sayıların anlamı değişiyor; orada ufak görünen farklar günün sonunda baya iş görüyor (inanın bana). Hani tek tek bakınca “idare eder” dersiniz. Ölçek büyüyünce tablo başka oluyor (özellikle (söylemesi ayıp) gecikme bütçesi dar olan sistemlerde). Neyse uzatmayayım, hız kısmı kağıt üstünde değil, gerçekten hissediliyor.

Peki Fiyatlandırma Tarafı? İşte Burada İşler Karışıyor

Açık konuşayım, OpenAI’ın fiyat tablosuna ilk baktığımda biraz duraksadım. GPT-5.5’te giriş token’ı GPT-5’e göre azıcık daha pahalı, çıkış tarafı işe neredeyse aynı kalıyor; ama işin içine “reasoning” modu girince tablo bir anda değişiyor, model arkada ekstra token harcıyor ve fatura da doğal olarak kabarıyor.

Tuhaf ama, Türkiye’deki şirketler için bu konu biraz daha hassas, hatta bazen can sıkıcı olabiliyor. Azure OpenAI üzerinden (söylemesi ayıp) tüketim yapıyorsanız TL kuru oynadığı için aylık bütçe bir anda %15-20 sapabiliyor (geçen ay bir e-ticaret müşterimizde, orta ölçekliydi. Aylık yaklaşık 8 milyon token dönüyordu, kur farkı yüzünden fatura beklenenden 4 bin TL fazla geldi), GPT-5.5’e geçince bu oynama daha da artabilir; o yüzden ben Azure Cost Management içinde muhtemelen budget alert kurun diyorum, günlük değil saatlik threshold tanımlayın, yoksa sonradan bakıp “bu nereden çıktı?” diye kalıyorsunuz.

Yeni bir modele geçerken en büyük hatam hep şu oldu: “Daha akıllı model = daha az token tüketir” diye düşünmek. Halbuki reasoning modelleri çoğu zaman tam tersini yapıyor, yani işi içeride biraz çevirip dolaştırıyor ve ilk ayın faturasına bakınca insan bunu net görüyor.

Maliyet Kıyaslama Tablosu

Size bir şey söyleyeyim, Aşağıda OpenAI’ın açıkladığı indikatif fiyatları ve benim sahada gördüğüm pratik kullanım maliyetlerini yan yana koydum. Rakamlar 1 milyon token başına ve USD cinsinden; küçük görünüyorlar ama hacim büyüyünce mesele bambaşka bir yere gidiyor.

| Model | Input | Output | Reasoning aktifken tahmini ek maliyet |

|---|---|---|---|

| GPT-4o | $2.50 | $10.00 | — |

| GPT-5 | $3.00 | $12.00 | %20-40 |

| GPT-5.5 | $3.50 | $12.00 | %30-55 |

| Claude Opus 4.7 | $15.00 | $75.00 | değişken |

Gördüğünüz gibi Claude hâlâ ayrı bir ligde duruyor, fiyat tarafında hiç saklamaya gerek yok; ama GPT-5.5 de performans iddiasıyla o tarafa göz kırpıyor açıkçası. Kullanım senaryonuzu iyi tartın, çünkü düşük hacimde idare eder görünen farklar yüksek hacimde can yakabiliyor.

Kurumsal vs Küçük Ekip: Kime Ne Uygun?

Burada net bir ayrım lazım, çünkü herkese aynı reçeteyi verince iş karışıyor. Siz ne dersiniz? Açık konuşayım, ekip boyutu ile risk iştahı aynı şey değil; küçük bir startup ile regülasyonlu bir bankanın model seçimi de, geçiş hızı da, hatta sabrı bile farklı oluyor. Daha fazla bilgi için Google’ın Yeni TPU Hamlesi: Ironwood ve Axion Sahnede yazımıza bakabilirsiniz.

İşin garibi, Küçük ekipseniz (startup, solo developer, 5-10 kişilik teknik takım): GPT-5.5’e bir anda atlamayın. Önce bir hafta GPT-5 ile paralel test yapın, gerçek iş yükünüzde ne değişiyor bakın; fark yaratıyorsa geçersiniz, yaratmıyorsa da acele etmeye gerek yok. Kısa vadede GPT-4o bile birçok işte gayet iş görüyor — ben bunu hâlâ birçok müşteride görüyorum, insanlar “en yeni model” diye koşuyor. Görevleri 4o ile zaten çözülüyor.

Bu konuyla ilgili GA4’ü Bırakıp Next.js + Supabase’e Geçmek: Neden? yazımıza da göz atmanızı tavsiye ederim.

Doğrusu, Kurumsal yapıdaysanız (500+ çalışan, regülasyonlu sektör, finans/sağlık/kamu): Geçiş kararını pilotla başlatın. Azure OpenAI tarafında “provisioned throughput” kullanıyorsanız kapasite planı yapmanız şart gibi duruyor; yoksa model iyi olsa bile sıra bekleyen istekler can sıkabiliyor. Logosoft’ta bir bankacılık müşterimizde geçen yıl GPT-4’ten GPT-4o’ya geçerken bile PTU hesabını yeniden yaptık ve süreç 3 hafta sürdü; 5.5 için de benzer bir tempo beklemek bence daha gerçekçi.

Hangi Kullanım Senaryolarında Gerçekten Parlıyor?

- Çok adımlı kod refactoring: En çok da de de 200+ satırlık dosyalarda tutarlılık artmış. Ben test ettim, fark var; ufak tefek değil yani.

- Veri analizi ve SQL üretimi: Karmaşık JOIN’lerde ve window function’larda eski modele göre daha temiz sonuç veriyor, bazen insan “hmm, bu sefer olmuş” diyor.

- Araştırma özeti (uzun döküman): 80-100 sayfalık PDF’lerde bağlam kaybı azalmış gibi duruyor ama bayağı bitmiş değil, o kısmı abartmayayım.

- Tool calling zinciri: Burası belki en büyük iyileşme. 6-7 tool’u arka arkaya çağıran agent senaryolarında hata oranı düşmüş; şey gibi değil artık her adımda tökezlemiyor.

Hayal Kırıklığı Yaşadığım Noktalar

Evet, var. Hani bazen yeni model çıkar da herkes “oh be nihayet” der ya — burada o duygu bende tam oluşmadı. İki yerde açıkça zayıf kaldığını gördüm; biri dil tarafıydı, diğeri de güven meselesi. Bu konuyla ilgili Azure Smart Tier GA: Blob Depolamada Otomatik Tasarruf yazımıza da göz atmanızı tavsiye ederim.

Birinçisi Türkçe çıktı kalitesi. Mesela teknik Türkçe’de (DevOps terminolojisi, bulut mimarisi) İngilizce kelimeler sızıyor ya da çeviriler biraz tuhaf kalıyor. “Dağıtım” yerine “deploy” demesi mesela, açıkça Türkçe istememe rağmen oluyor; küçük detay gibi görünüyor ama sunum hazırlarken insanın gözüne batıyor. Gateway API v1.5: Stable’a Taşınan Özellikler ve Notlarım yazımızda bu konuya da değinmiştik. Daha fazla bilgi için SELinux Volume Label Değişiklikleri GA: v1.37’de Neler yazımıza bakabilirsiniz.

İkincisi işe hallucination dediğimiz uydurma bilgi tarafı. Azure servisleri hakkında soru sorunca var olmayan bir SDK metodu önerdiği oldu; test ettim ve yoktu gerçekten yoktu. Bu tür “emin konuşup yanlış verme” hâli hâlâ devam ediyor. Claude Opus 4.7 GitHub Copilot’ta: Ne Değişiyor? yazımda da değinmiştim aslında bu mesele sadece OpenAI’a özgü değil; genel LLM dünyasının inatçı problemi bu biraz.

Pratik Geçiş Rehberi: İlk Adımlar

Neyse, Azure OpenAI tarafında GPT-5.5’i deneyecekseniz, ben olsam işi şöyle kurarım —. Lafı gevelemeden, önce küçük bir pilot açar, sonra da sonuçlara bakarım:

- Model availability check: GPT-5.5 henüz her Azure bölgesinde görünmüyor. East US 2, Sweden Central ve Japan East tarafında var; Türkiye North için işe bu yazıyı hazırladığım anda net bir duyuru yoktu (evet, iş biraz bölgeye takılıyor).

- Deployment oluşturun: Elinizdeki GPT-5 deployment’ını silmeyin. Yeni bir deployment açın. A/B test yapacaksanız bu kritik, çünkü eskiyi tutmadan sağlıklı kıyas zor oluyor.

- Traffic split: API Management ya da kendi gateway katmanınız üzerinden trafiğin %10’unu 5.5’e verin, geri kalanı olduğu gibi kalsın (ilk adımda hepsini yeni modele yüklemek pek akıllıca gelmiyor).

- Metrikleri karşılaştırın: Token kullanımı, latency, hata oranı ve kullanıcı memnuniyeti gibi şeyleri yan yana koyun; bazen model daha az token yakıyor ama cevap kalitesi öyle hemen parlamıyor, işte orada tablo değişiyor.

- 2 hafta sonra karar verin: Acele etmeyin. Model davranışı zaman içinde kayabiliyor, OpenAI bazen sessiz güncelleme yapıyor (bu ayrı bir mevzu), o yüzden kısa testle hüküm vermek bana biraz erken geliyor.

Yani, Basit bir test scripti ile başlamak isterseniz, aşağıdaki Python snippet’ını kendi ortamımda kullanıyorum; kod kısa duruyor ama pratikte sızı bayağı uğraştıran kısım endpoint ve deployment adlarını düzgün oturtmak oluyor:

import os

from openai import AzureOpenAI

import time

client = AzureOpenAI(

api_key=os.getenv("AZURE_OPENAI_KEY"),

api_version="2025-03-01-preview",

azure_endpoint=os.getenv("AZURE_OPENAI_ENDPOINT")

)

def benchmark(model_name, prompt):

start = time.time()

response = client.chat.completions.create(

model=model_name,

messages=[{"role": "user", "content": prompt}],

temperature=0.3

)

elapsed = time.time() — start

tokens = response.usage.total_tokens

return {

"model": model_name,

"elapsed_sec": round(elapsed, 2),

"tokens": tokens,

"cost_estimate": tokens * 0.0000035

}

# Her iki modeli de aynı prompt ile test et

test_prompt = "Write a Terraform module for Azure AKS with 3 node pools"

print(benchmark("gpt-5", test_prompt))

print(benchmark("gpt-5.5", test_prompt))Bütçe Kısıtlıysanız Alternatifler

Dürüst olmak gerekirse, Herkes OpenAI’a mecbur değil, bunu bence biraz daha yüksek sesle söylemek lazım. Eğer bütçe daraldıysa. GPT-5.5 faturayı şişiriyorsa, bir anda duvara tosladım hissine kapılmadan önce şu seçeneklere bakın; çünkü bazen işin çözümü modeli değiştirmek değil, akışı biraz akıllıca bölmek oluyor.

İşte tam da bu noktada devreye giriyor.

Bi saniye — Hibrit yaklaşım: Kolay işleri GPT-4o-mini’ye verip, gerçekten kafa isteyen tarafları 5.5’e aktarırsanız, router mantığıyla fatura ciddi biçimde düşüyor. Biz bunu bir müşteride bir düşüneyim… uyguladık; aylık 12 bin dolardan 5 bin dolara inmişti, hem de üç ay önce,. Öyle çok eski de değil. Kulağa basit geliyor ama bazen en iyi tasarruf, en gösterişli çözümden çıkmıyor.

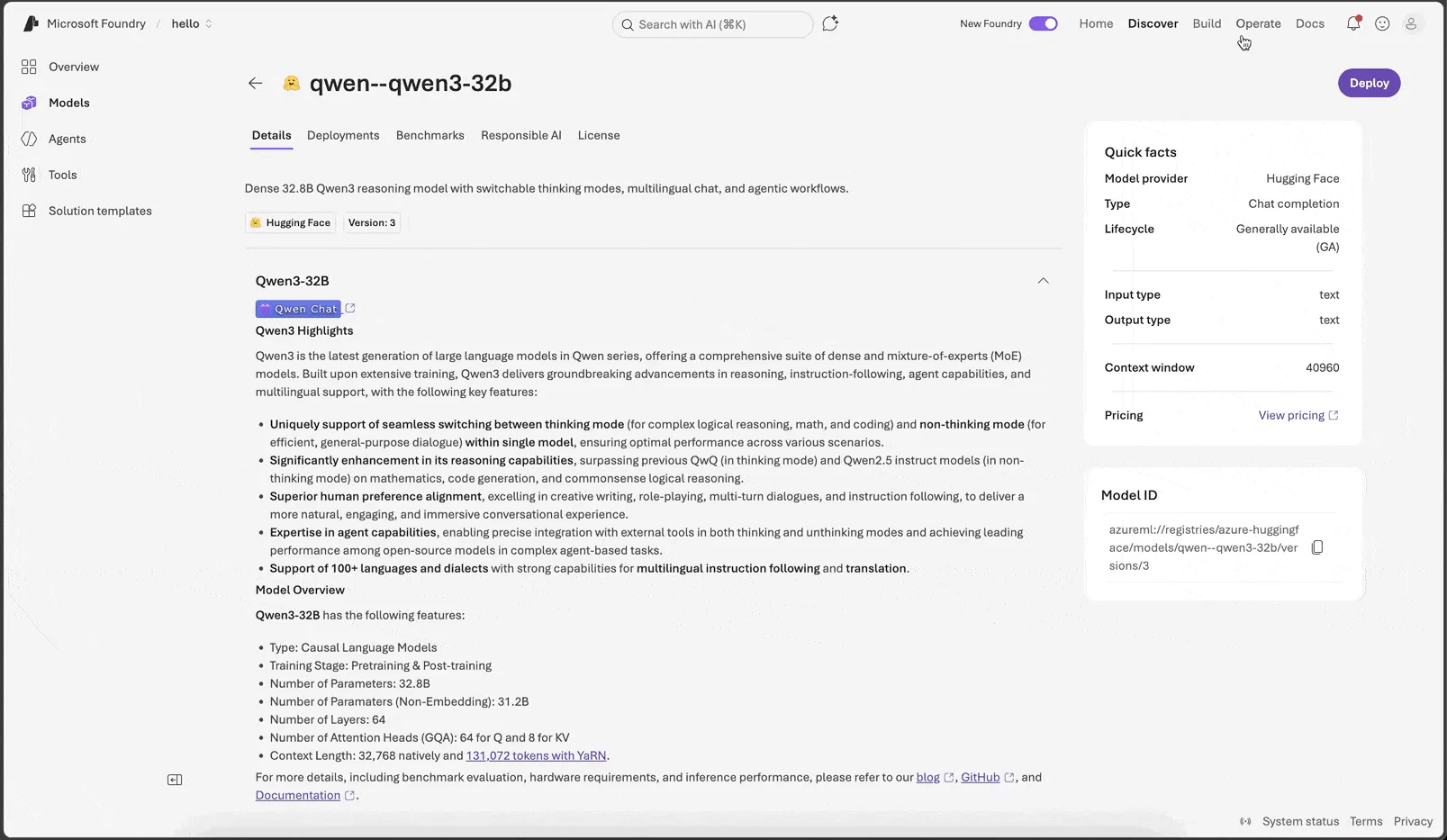

Open-source model + fine-tuning: Llama 3.3 70B ya da Qwen 2.5 gibi modeller bazı dikey senaryolarda GPT-5’e baya yaklaşıyor, hatta şaşırtıcı derecede iş görebiliyor. Azure ML üzerinde fine-tune edebilirsiniz, evet; ama burada küçük bir parantez açayım: bakım yükü az buz değil ve ekip ufaksa bu yola girmek sonra can sıkabiliyor.

Batch API: Eğer cevapların anlık gelmesi gerekmiyorsa OpenAI’ın batch API’si %50 indirimli çalışıyor, bu da özellikle nightly raporlar. Toplu sınıflandırma gibi işlerde gayet mantıklı bir avantaj sağlıyor. Microsoft Foundry Fine-Tuning Nişan 2026: RFT’de Yenilikler yazımda Azure tarafındaki benzer şeylerden de bahsetmiştim; isterseniz oraya da bir göz atın, çünkü bazı detaylar burada anlattığım yaklaşımla güzelce örtüşüyor.

Evet, doğru duydunuz.

Agent Senaryolarında Ne Değişti?

Bu başlık var ya, beni en çok dürten taraflardan biri. Çünkü 2026 yılı agent’ların yılı olacak gibi duruyor, hatta açık konuşayım, işaretler baya o yöne gidiyor; GPT-5.5 de tool calling tarafında gözle görülür biçimde daha iyi, özellikle de aynı anda 3-4 tool’u paralel çağırıp sonra sonuçları bir araya topladığı senaryolarda.

Ben geçen hafta bir müşteride MCP (Model Context Protocol) üzerinden 5 farklı kurumsal sistemi bağlayan bir agent kurdum: Jira, Confluence, Azure DevOps, Outlook (bizzat test ettim). SharePoint. İlk denemede GPT-5 ile 7 adımın 5’ını doğru yapıyordu; GPT-5.5’e geçince 7’de 6 oldu. Evet, hâlâ kusursuz değil. Ama yüzde yirmilik o fark, agent işlerinde küçümsenecek gibi değil; bu konuyu biraz daha eşeleyenler için CodeAct ve Hyperlight: Agent’ları Tek Hamlede Hızlandırmak yazımda mimarı tarafı daha detaylı anlattım.

Sıkça Sorulan Sorular

GPT-5.5 Türkiye’de Azure OpenAI’dan kullanılabilir mi?

Şu an için Türkiye North bölgesinde GPT-5.5 açılmıyor maalesef. East US 2, Sweden Central ve Japan East var ama hepsi bu kadar. Veri ikametgahı zorunluluğu olan kurumlar için bu aslında ciddi bir sorun. Bölgesel genişleme 2-3 ay içinde olacak gibi görünüyor, ama Microsoft kesin bir tarih vermekten kaçınıyor.

GPT-5’ten 5.5’e geçmek için kodumu baştan yazmam gerekiyor mu?

Hayır, gerekmiyor. API sözleşmesi aynı kaldığı için mevcut kodunuz olduğu gibi çalışıyor (evet, doğru duydunuz). Yani aslında sadece model parametresini değiştirmeniz yeterli. Ama şunu da söyleyeyim: reasoning modu açıkken token tüketimi arttığı için timeout ve retry ayarlarınıza bir bakın. En çok da streaming kullanıyorsanız ilk token gecikmesi değişiyor, tecrübeme göre UX’i mutlaka test etmek gerekiyor.

GitHub Copilot da GPT-5.5 kullanıyor mu?

Hayır. Copilot ayrı bir model ekosistemiyle çalışıyor, varsayılan model farklı. Artık Copilot içinden model seçimi yapılabiliyor, oradan GPT-5 ailesini tercih edebilirsiniz, ama 5.5’in Copilot’a entegrasyonu henüz duyurulmadı. Bence birkaç hafta içinde gelir.

GPT-5.5 için fine-tuning yapılabiliyor mu?

Şu an sınırlı. OpenAI “yakında” diyor, hani ne zaman olduğu belirsiz yani. Azure tarafında da RFT (reinforcement fine-tuning) bu modele henüz açılmadı. Açıkçası özel domain adaptasyonu yapmak isteyenler için şimdilik GPT-4o üzerinde fine-tuning yapıp sonuçları karşılaştırmak daha mantıklı bir yol.

Prompt injection saldırılarına karşı 5.5 daha mı güvenli?

OpenAI’ın sistem kartında direnç arttı diyor. Ben de birkaç bilinen injection tekniği denedim, 5.5 çoğunu yakaladı. Ama %100 değil, bunu net söyleyeyim. Yani modele tek başına güvenmemek lazım (evet, doğru duydunuz). Üretim ortamında mutlaka ek bir savunma katmanı kullanın, mesela Azure AI Content Safety veya kendi filter’larınız. Bu konuda asla şansa bırakmayın.

Kaynaklar ve İleri Okuma

OpenAI Resmî Duyurusu: Introducing GPT-5.5

Azure OpenAI Service Model Availability Dokümantasyonu (evet, doğru duydunuz)

Azure OpenAI Provisioned Throughput Units Rehberi

Bu içerik işinize yaradı mı?

Benzer içerikleri kaçırmamak için beni sosyal medyada takip edin.