Açık konuşayım: Cloud Next etkinliklerini yıllardır izliyorum,. Bu sefer beni en çok düşündüren şey donanım tarafı oldu. Google, Ironwood (TPU v7) adını verdiği yeni nesil AI hızlandırıcısını. Axion tabanlı yeni sanal makine ailelerini duyurdu. İsimler biraz süper kahraman filmi gibi duruyor, evet; ama altındaki hikâye hiç de hafif değil.

Şimdi şöyle bir durum var: Biz Azure tarafından bakanlar için Google’ın TPU dünyai hep biraz “uzak akraba” gibiydi. NVIDIA GPU’lar, Azure ND serisi, AMD MI300 derken Google kendi silikonunu sessiz sessiz pişirmeye devam etti; hatta bazen “bunlar ne yapıyor acaba” dedirten bir sakinlik vardı. Bu yazıda hem duyurunun teknik tarafını anlatacağım hem de bunun Türkiye’deki kurumsal AI stratejilerine ne yansıması olabilir, önü kurcalayacağım.

Kısa bir not düşeyim buraya.

Duyurunun Özeti: Ironwood ve Axion Nedir?

İşin garibi, Lafı gevelemeden iki temel başlığa bakalım. Google iki ayrı ürün duyurdu: biri saf AI iş yükleri için tasarlanmış bir TPU, diğeri işe Arm mimarisinde genel amaçlı bir CPU. İkisi aynı sofrada oturuyor ama tabakta farklı şeyler var; yani işin mantığı benzer görünse de kullanım alanı baya ayrışıyor.

Ironwood (TPU v7) — Inference Canavarı

Ironwood, Google’ın yedinci nesil TPU’su. Önceki nesillerden en büyük farkı, “agentic era” dedikleri —. AI ajanlarının sürekli çalıştığı, düşündüğü, başka modellerle konuştuğu dönem — için baştan aşağı yeniden tasarlanmış olması (inanın bana). Eskiden TPU’lar daha çok training (eğitim) tarafına abanıyordu, inference (çıkarım) ikinci planda kalıyordu; bu kez sanki direksiyon tam tersine kırılmış gibi.

Bilmem anlatabiliyor muyum, Rakamlara bakınca ortaya ilginç bir tablo çıkıyor: Önceki nesil Trillium’a (TPU v6) göre peak performansta ciddi bir sıçrama var. Ben AZ-305 sertifika çalışmalarımda inference maliyetlerinin training’e göre uzun vadede daha çok can yaktığını öğrenmiştim — sahada da durum genelde böyle oluyor zaten. Bir modeli bir kere eğitirsiniz ama milyonlarca kere çağırırsınız; Google da bu gerçeği görmüş besbelli.

Axion — Sessiz Sedasız Güçlenen Arm CPU

Axion tarafında işe C4A metal, N4A gibi yeni sanal makine tipleri geldi. Bunlar Arm tabanlı, Google’ın kendi tasarladığı CPU’lar. AWS’in Graviton hattına rakip bir ürün diyebiliriz (buna dikkat edin). Hani herkes NVIDIA GPU konuşuyor ya — Axion biraz kenarda durup “asıl iş şu CPU tarafında” diyen türden bir hamle gibi duruyor.

“AI ajanlarının çalıştığı dünyada sadece GPU/TPU yetmiyor. Ajanın arkasında API çağıran, veritabanı sorgulayan, cache’i yöneten bir sürü sıradan iş de var. Bu iş yükleri için x86 yerine Arm kullanmak — fena fikir değil.”

Agentic Era Derken Tam Olarak Ne Kastediliyor?

Bu “agentic” kelimesi son bir yıldır her yerde karşımıza çıkıyor. Microsoft Foundry’de de var, GitHub Copilot’ta da var, Azure AI Studio’da da… Herkes ajan diyor da peki donanım tarafında bunun karşılığı ne?

Hmm, bunu nasıl anlatsamdı…

Şöyle düşünün: Klasik bir chatbot iş yükünde siz soru sorarsınız, model cevap verir ve konu kapanır. Tek turluk sohbet yani. Oysa agentic sistemde model kendi kendine plan yapıyor, araç çağırıyor, sonuçları değerlendirip yeniden düşünüyor, hatta başka ajanlarla konuşuyor. Tek bir kullanıcı sorgusu arkada 10-15 değilse bile bazen 50 inference çağrısına dönüşüyor.

Geçen ay bir e-ticaret müşterimizde buna benzer bir kurgu yaptık (şaşırtıcı ama gerçek). Müşteri destek için bir ajan tasarladık — kullanıcı “siparişim nerede” diye soruyor, ajan önce kullanıcıyı tanıyor, sonra sipariş API’sını çağırıyor, sonra kargo firmasının API’sine gidiyor, sonra ETA hesaplıyor ve en sonunda doğal dilde cevaplıyor. Tek soru; yedi ayrı LLM çağrısı. Siz hiç denediniz mi? Inference yükü bildiğiniz gibi değil.

Şimdi gelelim işin can alıcı noktasına.

İşte Ironwood tam bu gerçeklik için tasarlanmış görünüyor. Bellek bant genişliği, düşük gecikme süresi, enerji verimliliği — hepsi inference yoğun senaryolar için optimize edilmiş durumda.

Rakamlar ve Karşılaştırmalar

Teknik detaylara biraz girelim. Aşağıdaki tablo Google’ın açıkladığı bilgilere ve benim sektörden takıp ettiğim rakamlara dayaniyor. Her şey kesin değil tabii; gerçek benchmark’lar ancak kurumsal testlerde netleşecek. google ile ilgili önceki yazımız yazımızda bu konuya da değinmiştik. Bu konuyla ilgili Docker İmajını Küçültmek: 1,58 GB’dan 186 MB’a yazımıza da göz atmanızı tavsiye ederim.

| Özellik | TPU v5e | Trillium (v6) | Ironwood (v7) |

|---|---|---|---|

| Ana Kullanım | Inference | Training + Inference | Inference (Agentic) |

| Pod Başına Chip | 256 | 256 | 9216+ |

| HBM Kapasitesi | 16 GB | 32 GB | 192 GB |

| Peak Performance (göreli) | 1x | ~4.7x | ~10x+ |

| Enerji Verimliliği | Baz | %67 daha iyi | ~2x daha iyi |

Pod başına 9000+ çip demek gerçekten az buz değil. Yani tek bir süper-pod içinde devasa bir LLM’i parçalara bölüp rahatça koşturabiliyorsunuz; Gemini gibi trilyon parametreli modeller için bu kritik bir detay.

Peki Bu Azure/AWS Dünyasını Nasıl Etkiler?

Ben Azure tarafında çalışan biri olarak söyleyeyim: Google’ın TPU hamlesi beni doğrudan değil. Dolaylı olarak etkiliyor. Neden? Çünkü fiyat rekabetini tetikliyor.

NVIDIA H100 fiyatları şu anda akıl almaz seviyelere çıktı. Azure’da bir ND H100 v5 instance’ı saatlik 40-50 dolar bandında dolaşıyor; Türkiye’deki bir müşteriye “ayda 30 bin dolarlık GPU kullanacaksınız” dediğinizde CFO’nün yüz ifadesi değişiyor, önü da söyleyeyim. Google TPU tarafında daha agresif fiyat verirse — ki muhtemelen verecek — Microsoft ve AWS de ister istemez dirsek atmak zorunda kalacak.

Bir de şu var: Google, Anthropıc’in Claude modellerini TPU üzerinde çalıştırıyor. OpenAI işe Azure’a sıkı sıkıya bağlı kalıyor. Bu iki ortam arasında “hangi donanım daha uygun maliyetli” savaşı artık sadece teknik tartışma değil; resmen stratejik satranç oyunu oldu.

Türkiye Perspektifi: Kurumsal Müşteriler Ne Yapmalı?

Kendi müşterilerimde gördüğüm kadarıyla Türkiye’de AI altyapısı benimsenmesi üç farklı kampa ayrılıyor:

- Muhafazakâr bankalar/sigorta: KVKK ve BDDK kısıtları yüzünden veriyi yurt dışına çıkaramıyorlar. Bunlar için TPU ne kadar ucuz olursa olsun, şu an Türkiye’de Google Cloud region’ı olmadığı için seçenek bile sayılmaz. Azure’un İstanbul ve Türkiye kuzey bölgeleri hâlâ en güvenli liman.

- Orta ölçek teknoloji şirketleri: Bunlar maliyet odaklı hareket ediyor. Eğer kullanım senaryosu uygunsa TPU denemeye açıklar; özellikle batch inference iş yüklerinde baya iş görebilir. (bu kritik)

- Startup’lar: Zaten çoğu Google Cloud credits ile başlıyor. Onlar için TPU doğal geçiş yolu gibi duruyor.

Eğer enterprise ile startup karşılaştırması yapacaksak şunu söyleyeyim: Büyük kurumsal yapıdaysanız. Zaten Azure/AWS üzerinde derin yatırımınız varsa, sırf TPU diye altyapı göçüne kalkmak şu an pek mantıklı değil. Multicloud stratejisi zaten başlı başına dertli bir konu; ama yeni bir AI projesi başlatıyorsanız ve veri hassasiyeti uygunsa — Vertex AI üzerinden Ironwood denemek bana kalırsa masada tutulmalı.

FinOps Tarafı: Bu İş Gerçekten Ucuz mu?

Bir şey dikkatimi çekti: Dikkat etmek lazım: Donanım benchmark’ı ile gerçek TCO (toplam sahip olma maliyeti) arasında epey mesafe var. TPU’nün saatlik fiyatı düşük olabilir ama mesele orada bitmiyor…

Birinçisi, TPU’ların yazılım ortamı NVIDIA CUDA kadar oturmuş değil. PyTorch var, JAX var, TensorFlow var evet; ama ekibinizin bu yapıya alışması zaman alıyor. Geçen sene bir fintech müşterimizde CUDA dışındaki bir platforma geçiş denemesi yapmıştık — üç ay boyunca sadece mühendis saati kaybettik. Sonunda geri döndük; açıkçası acı tecrübeydi.

İkincisi, TPU’lar paylaşılan pod yapısında çalışıyor. Yani küçük bir modeli tek başına koşturmak isteseniz bile belli minimum kaynak ayırmanız gerekiyor; bu da küçük ekiplerde verimsiz olabiliyor. Bu konuyla ilgili GA4’ü Bırakıp Next.js + Supabase’e Geçmek: Neden? yazımıza da göz atmanızı tavsiye ederim.

Maliyet Modellemesi İçin Basit Bir Örnek

Diyelim ayda 100 milyon token inference yapıyorsunuz; kabaca şöyle bakabilirsiniz: Bu konuyla ilgili TypeScript 7.0 Beta: Go ile 10 Kat Hızlanan Derleyici yazımıza da göz atmanızı tavsiye ederim.

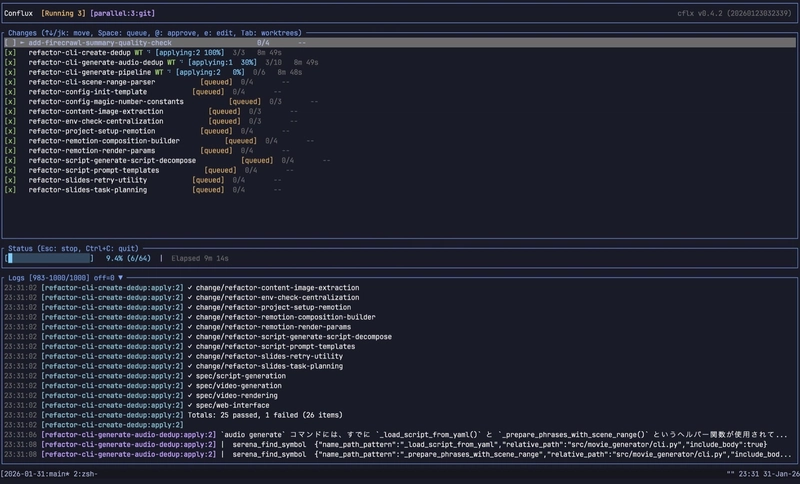

# Kabaca bir maliyet karşılaştırması (yaklaşık değerler)

NVIDIA H100 (Azure ND):

— Saatlik: ~$45

— Aylık 7/24: ~$32,400

— Token başı: ~$0.00032

TPU Ironwood (tahmin):

— Saatlik: ~$30-35 (henüz resmi değil)

— Aylık 7/24: ~$22,000-25,000

— Token başı: ~$0.00022

Serverless (Azure OpenAI GPT-4o):

— Sadece kullanım kadar

— Token başı: $0.0025 input / $0.01 output

— 100M token için: ~$5,000-12,000

Baktığınızda serverless hâlâ küçük ve orta ölçek için en rahat seçenek gibi duruyor. Bu ne anlama geliyor? TPU ya da GPU tarafında adanmış kaynak almak ancak hacim büyüdüğünde anlam kazanıyor; bu konuda Azure Smart Tier GA: Blob Depolamada Otomatik Tasarruf yazımda benzer bir maliyet optimizasyon mantığını depolama tarafında ele almıştım — prensip aslında aynı: kullanım paterninizi tanıyın. Hyatt ve ChatGPT Enterprise: Otelde AI Dönemi Başladı yazımızda bu konuya da değinmiştik.

Duygusal Değil Pratik Bakışla Geliştirici Perspektifi Nereden Başlamalı?

Aslında — hayır dür, daha doğrusu, Peki diyelim ikna oldunuz ve “ben bu Ironwood’u denemek istiyorum” dediniz; nereden başlayacaksınız? Pratikte şöyle ilerlemek daha doğru ölür:

- GCP hesabı açın ve Vertex AI’ı keşfedin. TPU’lara doğrudan dalmak yerine Vertex AI üzerinden managed servis olarak kullanmak daha kolay geliyor.

- CUDA bilginiz varsa geçiş tamamen yabancı gelmez ama farklı düşünme şekli istiyor.

- Küçük bir POC yapın. Model boyutu olarak önce 7B parametre civarında kalın; direkt büyütmeye kalkmayın.

- Kendi iş yükünüzle ölçün — Google’ın rakamları pazarlama rakamları olabilir, sizin ortamınızda başka türlü çıkabilir.

- Teknik ekip “süper bu” dese bile finans onay vermiyorsa proje yürümüyor.

Eğer AI ajan tarafında Microsoft çevreinde kalmak istiyorsanız Azure Developer CLI ve Copilot: Terminalde AI Dönemi ve Microsoft Foundry Fine-Tuning Nişan 2026: RFT’de Yenilikler, yazılarım ilgini çekebilir — oralarda benzer ajan-dostu altyapı trendini Azure tarafından anlatıyorum.Beni Rahatsız Eden Noktalar

Bütün tablo güllük gülistanlık değil tabii ki; açık konuşmam gerekirse duyuruda beni kaşındıran birkaç nokta var.

Eh, Bunlardan ilki vendor lock-in meselesi. TPU’ya yatırım yaptığınız anda kodunuzun ciddi kısmı Google dünyaine bağlanıyor gibi hissediyorsunuz; yarın fiyat artarsa ya da servis şartları değişirse geri dönüş kolay olmuyor. Biz danışman olarak müşterilere hep multi-cloud flexibility diyoruz. Pratikte çoğu ekip tek bulutta demir atıp kalıyor zaten.

Anlatayım mı? İkinci mesele bölgesel yayılım konusu (ki bu çoğu kişinin gözünden kaçıyor). Google Cloud’un Türkiye’de region’ı yok. En yakın konum Frankfurt veya Varşova. Bazı iş yüklerinde latency can sıkabiliyor; Azure’un Türkiye region’ına alışmış müşteriler için bu ciddi engel oluyor. Üçüncü mesele işe benchmark şeffaflığı. Google “10 kat daha hızlı” gibi iddialar atıyor ama hangi koşullarda, hangi modelle, hangi batch size ile olduğu pek net değil; bağımsız testler çıkana kadar ben o rakamları biraz temkinli okurum, hatta tuzla buz tane tane yutarım diyeyim.

Sıkça Sorulan Sorular

TPU Ironwood ile NVIDIA H100 arasındaki fark ne?

Ironwood, Google’ın sıfırdan tasarladığı bir ASIC — yani aslında yalnızca inference için yapılmış özel bir çip. H100 işe daha genel amaçlı bir GPU; hem training hem inference’ta kullanılıyor. CUDA ekosistemi açısından H100 hâlâ daha olgun, bence bu önemli bir avantaj. Ama Ironwood, belirli senaryolarda fiyat-performans açısından ciddi şekilde öne geçiyor.

Türkiye’den bağlanacaksam hangi region’ı seçmeliyim?

Şu an Türkiye’de Google Cloud region’ı yok maalesef. En yakın seçenekler europe-west3 (Frankfurt), europe-west4 (Hollanda) ve europe-central2 (Varşova). Tecrübeme göre Frankfurt genellikle en iyi tercih — yaklaşık 40-55 ms civarında bir gecikme alıyorsunuz, idare eder.

Küçük startup’lar için TPU mu, serverless AI mi?

Açık konuşayım, Açıkçası, ayda 50 milyon tokenın altındaysanız serverless’a gidin — Vertex AI API veya Azure OpenAI. TPU adanmış bir kaynak, yani sürekli yüksek throughput yoksa pek mantıklı değil. Ama özel modellerinizi host edecekseniz ya da yüksek hacimli işleriniz varsa, o zaman ekonomik olmaya başlıyor.

Axion CPU, AWS Graviton’dan ne farkı var?

Dürüst olmak gerekirse, İkisi de Arm tabanlı ve benzer hedef kitleye hitap ediyor. İlk benchmark’lara bakınca genel amaçlı iş yüklerinde performansları birbirine yakın. Ekosistem olgunluğu açısından Graviton hâlâ önde — bu yadsınamaz. Ama Google’ın kendi servisleri, yani GKE ve Cloud Run, Axion desteğini hızla yayıyor; bence önümüzdeki süreçte fark kapanacak.

CUDA kodumu TPU’ya taşımak çok mu zor?

Doğrudan taşımak mümkün değil, mimariler farklı. Ama PyTorch/XLA kullanırsanız kodun büyük kısmını yeniden kullanabiliyorsunuz — sıfırdan yazmak zorunda değilsiniz. Genelde iyi bir ekip için 2-4 haftalık bir adaptasyon süreci yeterli oluyor, tabi modelin ne kadar karmaşık olduğuna göre bu değişiyor.

Kaynaklar ve İleri Okuma

Google Cloud Blog: New TPUs for the Agentic Era

Google Cloud TPU Resmî Dokümantasyonu

Bu içerik işinize yaradı mı?

Benzer içerikleri kaçırmamak için beni sosyal medyada takip edin.