Bir yapay zekâ metnini “insan gibi” göstermek, dışarıdan bakınca tek hamlelik bir iş gibi duruyor. Hani biraz dolgu ekle, iki cümleyi kısalt, bir parça tereddüt serpiştir… tamamdır sanıyorsunuz. Ama işin aslı şu: benim editör masasında defalarca gördüğüm şey tam tersi — küçük görünen bazı dokunuşlar oyunu tamamen değiştiriyor, bazıları işe kağıt üstünde güzel durup pratikte neredeyse hiç fark yaratmıyor.

Geçen ay Kadıköy’de bir kahve dükkanında kendi not defterimi açıp benzer bir deneme akışı kurarken şunu düşündüm: “Acaba insanı en çok ne ele veriyor?” Cevap, beklediğim kadar romantik değildi. Ne büyük laflar, ne karmaşık kelimeler. Asıl belirleyici olan şey çoğu zaman ritim oldu. Bir metnin nefes alması, sonra hızlanması, ardından kısa bir duraklama yapması. Biraz müzik gibi, yani.

Neden Her İyi Sonuç Güven Vermez?

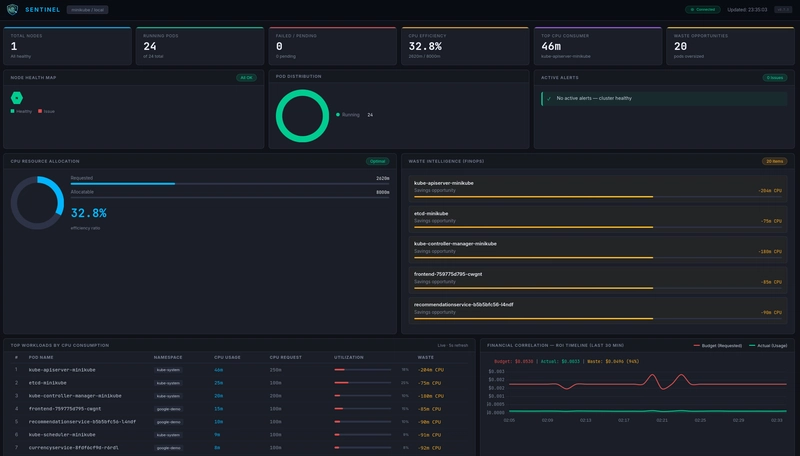

Bazen skorlar şişer. Nokta. Bir sistem yüksek puan alır ama neden aldığını açıklayamazsanız ortada ciddi bir sorun var demektir. Ben bunu ilk kez 2023 sonbaharında İstanbul’daki küçük bir ürün ekibiyle çalışırken yaşadım; ekip metin dönüşüm motorunda “harika sonuç” diye seviniyordu, hangi modülün katkı verdiği bilinmiyordu ama. Sonra iki modülü kapattık ve sistemin aslında sandıkları kadar sağlam olmadığını gördük.

İşte burada ablation study devreye giriyor. Sade söyleyeyim: sistemi tek tek parçalarına ayırıp “bu parça kapalıyken ne oluyor?” diye bakıyorsunuz. Laboratuvar işi gibi görünür. Pratikte işe bayağı hayat kurtarıyor — çünkü iyi görünen çıktının arkasında bazen tek başına filler ekleme vardır, bazen uzun-kısa cümle dengesi, hatta bazen düpedüz tesadüf.

Bu yaklaşımı seviyorum çünkü sızı hissiyattan çekip veriye getiriyor. Açık konuşayım, teknoloji dünyasında hissiyatla yürüyen çok ekip gördüm; sonuç genelde aynı oluyor — ya fazla özgüven ya da gereksiz karmaşa. Veri bazlı kırılım yaptığınızda işe her şey biraz daha çıplak hâle geliyor. Hoş olmayan tarafı da bu zaten.

Sistemi İnsanlaştıran Şey Ne?

Garip gelecek ama, Bir AI metnini daha doğal yapmak için kullanılan birkaç klasik dokunuş var. Bunların hepsi aynı ağırlıkta değil. Mesela dolgu ifadeleri (“well”, “you know”, “basically”) çoğu zaman çok sağlam sinyal veriyor, çünkü insanlar bunları sık kullanıyor. Model üretirken pek doğal gelmiyor. Buna karşılık öz-düzeltme cümleleri — “bir dakika, yani şunu demek istedim” tarzı — kulağa insansı geliyor; fakat kullanım sıklığı o kadar düşük ki etki alanı sınırlı kalabiliyor.

Hmm, bunu nasıl anlatsamdı…

Bir bakıma, ben bunu ilk test ettiğimde şaşırmıştım doğrusu. Ankara’da yaptığım ufak bir içerik denemesinde kendime “tamam, en insanı his veren şey öz-düzeltme olacak” demiştim. Sonra ölçüm geldi. Yüzümde hafif bir boşluk oluştu… çünkü o hamle neredeyse hiç katkı vermiyordu. Beklediğim kadar değildi. Google AI Edge Gallery, Gemma 4 ile telefonu mini laboratuvara çeviriyor yazımızda bu konuya da değinmiştik. Bu konuyla ilgili Butterfly CSS: 2026’da Dikkat Çeken Hafif Bir Seçenek yazımıza da göz atmanızı tavsiye ederim.

| Teknik | Etkisi | Pratik yorum |

|---|---|---|

| Dolgu ifadeleri | Yüksek | İnsan diline en hızlı yaklaşan unsur |

| Uzun cümleyi bölme | Orta-yüksek |

# Basit mantık

if filler == on:

human_score += high

elif self_correction == on:

human_score += low

# Ama asıl mesele sadece "aç/kapa" değil,

# hangi kombinasyonun ritmi değiştirdiği.

Ablation Mantığı Neden Bu Kadar Değerli?

İlginç olan şu ki, Ablation study’nın güzel yani şu… size sadece sonuç vermiyor, karar verme zemini de sağlıyor. Küçük bir startup için bu inanılmaz önemli; kaynak sınırlı oluyor çünkü, her fazladan modül maliyet demek. Kurumsal tarafta işe mesele başka bir hâl alıyor — orada bakım yükü patlıyor. Gereksiz modüller sistemi hantallaştırıyor. AI Ajanlar Neden Yalan Söyler: Asıl Ders Ne? yazımızda bu konuya da değinmiştik.

Ve işler burada ilginçleşiyor.

Mesela SaaS ürünü geliştiren bir ekip düşünün. Ürün yöneticisi size diyor ki “Bu beş özellik de iyi görünüyor.” Güzel, ama beşi de gerçekten lazım mı? Ben benzer soruyu geçen yıl Levent’teki bir toplantıda duydum ve not aldım — çünkü cevap teknik olduğu kadar stratejikti de; bazı özellikler ürünün tadını veriyor ama fatura kesmeye başlayınca can sıkıyor.

En can alıcı ayrım nerede çıkıyor?

Aynı anda hem kaliteyi hem maliyeti düşünmek zorundasınızsa önce etkisi yüksek hamlelere odaklanırsınız. Dolgu kelimeleri genelde bu gruba giriyor (şaşırtıcı ama gerçek). İnsan sesi açısından bariz sinyal veriyorlar çünkü. Ama hemen ardından şunu da görmek lazım — sadece dolguya abanırsanız metin yapay biçimde konuşkanlaşıyor. Doğal olmaktan uzaklaşabiliyor. Dozaj meselesi, yani.

Küçük ekip ile büyük ekip arasındaki fark

Küçük ekipler çoğu zaman hızlı kazanımı sever; kısa sürede fark yaratan iki adımı seçip gerisini bekletmek mantıklı olabilir mesela. Enterprise seviyede işe ölçülebilirlik öne çıkar — güvenlik incelemesi, regresyon testi, log takibi… Hepsi gerekir. Hepsi.

Bence en önemli ders ne?

Skor yükselmiş olabilir ama sebep anlaşılmıyorsa o skor biraz süs gibidir; güzel görünür fakat karar almak için zayıftır.

Bak şimdi, bu tür analizlerde asıl tehlike regex tuzağıdır. Evet, hâlâ. Basit eşleşmeler bazen masum görünen kelimeleri yanlış sayar ve sızı yanlış sonuca sürükler. Geçen sene İzmir’den gelen bir veri setinde ben buna takıldım; “like” ifadesi hem dolgu hem fiil olarak sayılınca oranlar çöktü gitti…

Denge Meselesi: Uzun Cümle mi Kısa Cümle mi?

İnsan dili tek tıp değil. Zaten dediğimiz şey tam da bu noktada anlam kazanıyor. Uzun cümleler açıklama verir, kısa cümleler ritim kazandırır. Araya küçük ünlemler, tereddütler, anı dönüşler girince metin canlı oluyor — yoksa aynı tempoda akan paragraf, kusura bakmayın, biraz robot gibi duyuluyor. Daha fazla bilgi için OpenAI’dan Güvenlik İçin Yeni Hamle: Fellowship Programı Ne Anlatıyor? yazımıza bakabilirsiniz.

Şimdi gelelim bence işin en ilginç kısmına: uzun cümlenin kısaltılması ile kısa interjection eklenmesi aynı şeyi yapmıyor. Biri ortalama uzunluğu düşürüyor. Öteki varyansı artırıyor. Yani matematiksel olarak farklı kapıları açıyorlar — pratikte bunun anlamı şu: okur akış içinde nefes alıyor, bir an hızlanıyor, sonra duruyor… sonra tekrar devam ediyor.

Burada yapılan hata şu bence: herkes vurucu görünen şeyi büyütüyor, sessiz çalışan etkiyi küçümsüyor. Oysa insanlık tam da o sessiz boşluklarda saklı olabilir. Mesela “Hmm.” gibi minicik ara sözler veya “Tamam.” tarzı kısa yanitlar, metne gereksiz süs katmadan karakter veriyor. Bir startup bloğunda bunu denediğimde okuma süresi azıcık arttı; daha önemlisi yorumların tonu yumuşadı. Tesadüf mü? Belki… ama tekrar edince tesadüf kokusu azalıyor. Daha fazla bilgi için PDF Dünyasında Bir Nefes: Ücretsiz ve Limitsiz Araçlar yazımıza bakabilirsiniz.

- Daha doğal görünmesini istiyorsanız: sadece filler yetmez.

- Daha inandırıcı olmasını istiyorsanız: cümle uzunluğu dalgalansın.

- Daha kontrollü sonuç istiyorsanız: her adımı ayrı ölçün.

- Daha güvenli ürün istiyorsanız: yanlış pozitifleri temizleyin.

Neyi Çıkarmalıyız? Neyi Tutmalıyız?

Bazen en doğru karar yeni şey eklemek değil, işe yaramayan şeyi söküp atmaktır. Kulağa acıtıcı geliyor, biliyorum. Ama gerçek bu. Öz-düzeltme enjeksiyonu bazı senaryolarda neredeyse sıfır katkı verebiliyor; o yüzden önü ana hatta taşımamak gayet mantıklı olabiliyor.

Buna karşılık dolgu ifadeleri neredeyse iskelet görevi görebiliyor. Ama yine dikkat: fazlası boğar. Ben bunu Berlin’de düzenlenen küçük bir online atölyede test ettim; katılımcılar “insansı oldu” derken ikinci turda bazı cümlelerin fazla gevşediğini söyledi. Yani evet, iş görüyor — ama dozaj meselesi kritik.

Peki ideal kurulum nasıl ölür?

Ana kombinasyon:

- Filler insertion

- Long sentence splitting

- Short sentence insertion

- Hedge injection

Opsiyonel:

- Cushion injection

Simdilik dusuk oncelik:

- Self-correction injection

E tabi her proje aynı değil. Müşteri destek botu yazıyorsanız tonlama başka önem taşır; haber özeti üretiyorsanız doğruluk daha kritik ölür; kurumsal rapor hazırlıyorsanız aşırı samimiyet zaten istemezsiniz. İlginç, değil mi? O yüzden reçete sabit değil, bağlam sabit değil — bu ikisini karıştırınca işler çorba oluyor.

Kendi Not Defterimden Üç Kural

Nişan ayında Beşiktaş’taki ofiste otururken üç madde yazmıştım ve hâlâ geçerli olduklarını düşünüyorum. Birinçisi: ölçmediğin şeyi optimize etme. İkincisi: ilk parlak sonuca kanma. Siz ne dersiniz? Üçüncüsü: görsel olarak güzel duran şey ile model davranışı arasında mesafe olabilir.

- Düşük frekanslı öğeler çoğu zaman sezgisel olarak sağlam görünür ama veri onları desteklemeyebilir.

- Cümlenin ritmi, tek tek kelimelerden daha kuvvetli sinyal verebilir.

- Regex ile yapılan kaba sayımlar önce temizlenmeli — yoksa tüm yorum kayabilir.

Sıkça Sorulan Sorular

Ablation study nedir?

Doğrusu, Ablation study, bir sistemdeki parçaları tek tek kapatıp hangi bileşenin gerçekten işe yarayan olduğunu ölçme yöntemidir.

AI modellerinde hangi adımın fayda verdiğini anlamak için çok kullanılır.

AI metnini insan gibi göstermek için en etkili yöntem hangisi?

Şunu fark ettim: Tek başına sihirli bir yöntem yok ama dolgu ifadeleri ve cümle ritmi genelde güçlü etki verir.

Yine de sonuç bağlama göre değişir; her projede aynı ayar çalışmaz.

Sadece öz-düzeltme eklemek yeterli mi?

Pek değil.

Öz-düzeltme kulağa insansı gelebilir ama kullanım sıklığı düşükse etkisi sınırlıdır.

Küçük ekipler için en mantıklı yaklaşım nedir?

Bilmem anlatabiliyor muyum, Kısıtlı bütçe varsa önce etkisi yüksek ve kolay ölçülen adımlara odaklanmak gerekir.

Gereksiz modülleri erken aşamada elemek hem maliyet hem bakım açısından rahatlatır.

Kaynaklar ve İleri Okuma

Orijinal Yazı — On the Dissecting Table

Scikit-learn Model Evaluation Dokümantasyonu

Bu içerik işinize yaradı mı?

Benzer içerikleri kaçırmamak için beni sosyal medyada takip edin.