18 Mart 2026 sabahı, İstanbul’da masaya oturdum ve “bunu iki dakikada hallederim” dedim. Hani o his var ya — her şey yolundaymış gibi görünür, loglar sakın, dashboard temiz… sonra fark edersin ki ekranın anlattığı hikâye ile gerçek birbirini hiç tutmuyormuş. Üç saatlik debug seansının ortasında bunu anladım. Küçük görünen problem, büyük çoğunluk sistemin sınır uçlarına dokunmuştu.

Bu yazıda sadece o bug’ı anlatmayacağım. Asıl mesele şu: Claude Code gibi ajan tabanlı araçlarla Kubernetes üstünde çalışırken iş akışınız köklü biçimde değişiyor — buna bir de GitHub Copilot Pro’yu model hub’ı gibi kullanma fikri eklenince, işler hem ilginçleşiyor hem de karmaşıklaşıyor. Açık konuşayım: kâğıt üstünde süper görünüyor, pratikte işe bazı yerler hâlâ ham.

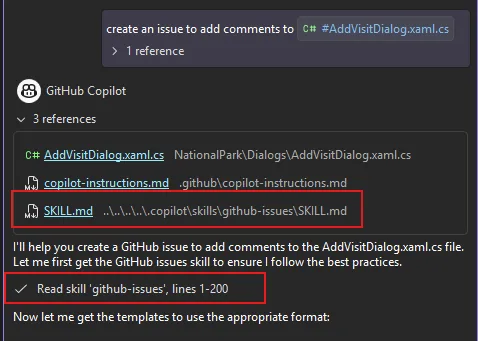

İşin Kalbi: Copilot Pro’yu Model Hub Gibi Kullanmak

Bence günün en önemli kırılması buydu. Tek modelle yürümeye çalışmak, bütün işi aynı tornavidayla çözmeye benziyor — biri vida sökerken iyi, diğeri hassas ayarda iş görüyor, fakat ikisi aynı araç değil. GitHub Copilot Pro tarafında gördüğüm şey de tam buna benziyor; farklı görevler için farklı model seçmek, düşündüğümden çok daha fazla anlam ifade ediyordu.

Size bir şey söyleyeyim, Mesela hızlı ilk kontrol için GPT-4.1 mini kullanmak mantıklı. Ucuz, seri. “Burada bariz saçmalık var — ki bu tartışılır — mı?” sorusuna çabuk cevap veriyor. Ama mimarı tartışma açıldığında, ya da edge-case kovalamak gerektiğinde GPT-5.3 Codex gibi daha derin düşünen bir modele geçmek çok daha akıllıca oluyor — fark, gerçekten hissediliyor.

İşte tam da bu noktada devreye giriyor.

Bir arkadaşım 7 Şubat 2026’da Ankara’daki küçük SaaS şirketinde bunu denemiş; sürekli tek modele yüklenmek yerine review akışını parçalara bölmüşler ve gereksiz token tüketimini ciddi biçimde kısmışlar. Ben de kendi tarafımda benzer sonucu gördüm, şaşırdım açıkçası: model seçimi aslında bir FinOps konusuna dönüştü, kulağa tuhaf geliyor ama işin aslı bu (ben de ilk duyduğumda şaşırmıştım)

Ha, şunu da söyleyeyim — Sonnet 4.6 burada beklediğimden iyi çıktı. Opus kadar ağır davranmadan benzer kalite vermesi güzel, ama her durumda kusursuz değil. Bazı uzun zincirli kararlarda hâlâ “emin mısın?” diye sormak gerekiyor. İdare eder diyemem, ama tam güvenmek de zor.

| Aşama | Kullandığım yaklaşım | Neden? |

|---|---|---|

| İlk tarama | GPT-4.1 mini | Hızlı hata yakalama |

| Mimarı inceleme | GPT-5.3 Codex | Daha derin muhakeme |

| Zor analizler | Claude Opus / Sonnet 4.6 | Daha güçlü bağlam takibi |

| Süreklilik | Sonnet 4.6 | Daha düşük tüketim, yeterli kalite |

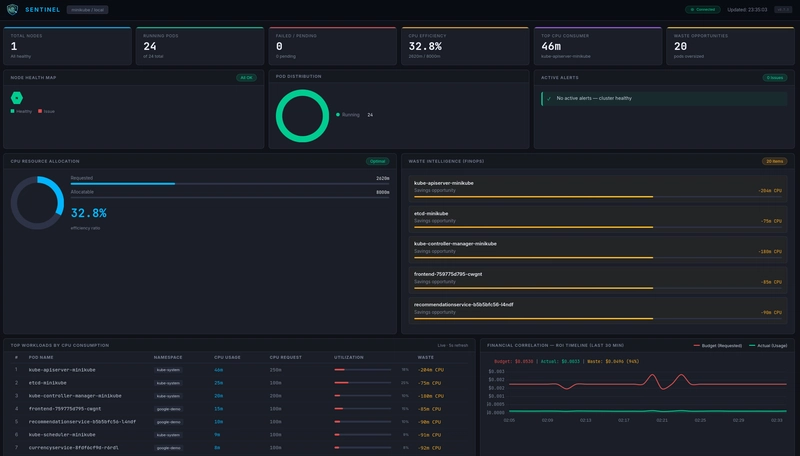

Kubernetes Tarafında Temizlik: Gürültüyü Azaltmak İyi Fikir mi?

İlginç olan şu ki, Evet. Ama kolay değil. Önceki düzende Prometheus, Grafana (kendi tecrübem). Alertmanager üçlüsü vardı; çalışıyordu tabii, ama lokal ortamda fazlasıyla ağırdı — her şeyi izlemek güzel bir his, ta ki başlangıç süresi uzayana ve üç ayrı port-forward peşine düşünceye kadar. O noktada “güzel his” yerini sinire bırakıyor. M||D||JS: Kod Satırını Bir Tane Yapınca Ne Oluyor? yazımızda bu konuya da değinmiştik.

Ben geçen yıl Kasım ayında kendi test ortamımda buna benzer bir şey yaşamıştım; sırf gözlemleme katmanı yüzünden demo sunumu gecikmişti. Baya sınır bozucuydu, o gün. O yüzden Sentinel’de Go agent’ın tek kaynak hâline getirilmesi bana çok mantıklı geldi: doğrudan client-go ile veri çekmek, PostgreSQL’e yazmak ve REST API üzerinden servis etmek — sadeleşme bazen lüks değil, zorunluluk oluyor. Bu konuyla ilgili Butterfly CSS: 2026’da Dikkat Çeken Hafif Bir Seçenek yazımıza da göz atmanızı tavsiye ederim.

Ama dürüst olayım. Gözlemlenebilirliği tamamen kaldırınca rahatlıyorsunuz, hmm, ama sistemi izlemek için yeniden araç inşa etmeniz gerekiyor. “Daha az bileşen” demek otomatik olarak “daha az dert” anlamına gelmiyor; sadece dert tipi değişiyor. Bunu baştan bilseydiniz iyi olurdu.

Bi saniye — Küçük startup için bu yaklaşım baya iyi çalışır — ekip sayısı azdır, operasyon yükünü hafifletirsiniz. Kurumsal tarafta işe durum başka; audit ihtiyacı varsa veya SLA baskısı yoğunsa merkezî metrik katmanını tamamen kapatmak pek parlak bir fikir olmayabilir. Gerçekten olmayabilir.

Neyi kazandırıyor?

- Daha az başlangıç bağımlılığı

- Düşük bakım yükü

- Lokal geliştirmede daha hızlı döngü

- Kubernetes içinde daha temiz kurulum deneyimi

- Ajanın doğrudan veri sahibi olması sayesinde daha az senkronizasyon sorunu

Neyi kaybettiriyor?

- Zengin dashboard ekosistemi azalıyor

- Karmaşık görselleştirme ihtiyaçları zorlaşıyor (bence en önemlisi)

- Sorun analizi için yeni araçlar gerekebiliyor

- Kısa vadede “hazır rahatlık” hissi düşüyor

Helm Chart ve Retention Katmanları Neden Önemli?

Bana sorarsanız Sentinel’in bugün olgunlaşmasında Helm chart kritik rol oynadı. Uygulama artık yalnızca çalışan bir servis değil — tekrar kurulabilen, taşınabilen. Versiyonlanabilen bir paket hâline geliyor. Bu çok büyük fark yaratıyor. Hele bir de de test ortamından üretime giden yol her zaman bir noktada dağılıyor ya, Helm o dağılan parçaları biraz toparlıyor, en azından kısmen.

Hmm, bunu nasıl anlatsamdı… 32 Saat Geri Kazandıran Yapay Zekâ Ajanları: Gerçek Hesap yazımızda bu konuya da değinmiştik.

Aynı şeyi kendi projemde Temmuz 2025’te yaşadım; Berlin merkezli küçük ekip AtlasForge içindeki PoC’de manuel YAML dosyaları iyice çorba olmuştu — evet, tam olarak çorba. Chart’a geçince kurulum standardize oldu ve yeni gelen mühendis iki saat içinde ayağa kalktı. İki saat. Öncesinde bu bir günlük işti. Pokemon Kartlarında Yapay Zekâ Hamlesi: Fiyat, Grading ve Ajanlar yazımızda bu konuya da değinmiştik.

Sentinel tarafındaki retention yapısı da önemliydi. Raw veriyi kısa süre tutup hourly ve daily özetlere geçmek depolama baskısını baya azaltıyor — bu tür katmanlı saklama mantığı özellikle PostgreSQL kullanan projelerde altın değerinde, çünkü ham veri çığ gibi büyürken sorgu performansı da sinsice düşüyor, fark etmiyorsunuz bile. Siz hiç denediniz mi? İşte tam burada modelin ürettiği kod kadar veri yaşam döngüsünün tasarımı da önem kazanıyor. Daha fazla bilgi için PDF Dünyasında Bir Nefes: Ücretsiz ve Limitsiz Araçlar yazımıza bakabilirsiniz.

# Kabaca retention mantığı böyle düşünülebilir

raw:

interval: 10s

retention: 24h

hourly:

interval: 1h

retention: 30d

daily:

interval: 1d

retention: 365d

}Bana Göre En Güzel Kısım Neresi?

Neyse uzatmayayım. En hoşuma giden taraf hızdan çok akışın şekil değiştirmesi oldu — bir komut satırı aracının etrafında bütün çalışma düzeniniz değişiyorsa, orada ciddi bir dönüşüm vardır. Claude Code + OpenCode + Copilot Pro kombinasyonu bunu sağlıyor, en azından benim kurulumumda sağladı.

Editör masasındayken insan fark ediyor: artık görevler arasında zıplamak yerine bağlam taşıyorsunuz. Önemli bu. Çünkü eski yöntemle her araç geçişinde kafa sıfırlanıyordu, yorgunluk artıyordu, karar kalitesi düşüyordu — ajan tabanlı düzen bunu biraz yumuşatıyor, her zaman değil. Çoğunlukla.

Kusursuz mu? Değil. Bazen model fazla özgüvenli konuşuyor, bazen gereksiz detay veriyor, bazen de basit soruda bile gereğinden fazla düşünceli davranıp sızı bekletiyor. Ama açık konuşayım: klasik elle yazılan akışa göre yine de net avantaj sağlıyor (bu konuda ikircikliyim). Mesela de küçük ekiplerde iş bölümü iyi kurulduysa sonuç fena çıkmıyor. Kurumsalda işe politika katmanı devreye girince işler ağırlaşır (buna dikkat edin). normaldir, beklenen bu zaten.

“Dashboard’un yalan söylemesi çoğu zaman dashboard’un suçu değildir; ölçüm zincirinin herhangi bir yerinde kopukluk vardır.”

Evet, sorun çoğu zaman ekranda değil altyapıda saklanır.

Dikkat Etmeniz Gerekenler ve Pratik İpuçları

Uzun oturumlarda tmux gibi araçlar hâlâ hayat kurtarıyor — bunu küçümsemeyin.

Model seçimini görev tipine göre yapın.

Metrik toplama ile karar verme mekanizmasını aynı yere yığmayın.

Retained data katmanlarını baştan planlayın.

Ve mümkünse her şeyi tek ilaca bağlamayın… bu genelde sonradan patlıyor.

İşte, i̇lginç olan şu ki, Bir de şu var. Ajanlara fazla güvenmeyin, ama onlardan korkmayın da. Denge lazım. Benim test ettiğim yapıların çoğunda en sağlam sonuç şu şekilde çıktı: önce hızlı model, sonra derin inceleme, ardından gerektiğinde insan onayı. Bu üçlü yapı özellikle debugging sırasında çok işe yarıyor — defalarca gördüm, şans değil bu.

Sıkça Sorulan Sorular

Copilot Pro gerçekten birkaç modeli aynı anda kullanmaya izin veriyor mu?

Doğrudan tek panelden hepsini sihir gibi yönetmiyorsunuz ama farklı modeller arasında çalışma akışı kurabiliyorsunuz.

Asıl fayda burada çıkıyor zaten:

tek sağlayıcıya sıkışmadan uygun modeli seçmek.

Kubernetes içinde doğrudan client-go ile veri toplamak riskli mi?

Riskleri var tabii; RBAC ayarlarını gevşek bırakırsanız sorun çıkar.

Ama doğru ServiceAccount ve minimum yetki prensibiyle gayet temiz çalışır.

Grafana’yı tamamen bırakmak mantıklı mı?

Küçük çevrede evet olabilir.

Kurumsal ölçekte işe hemen değil.

Önce ihtiyaç listenizi çıkarın… sonra karar verin.

Sadeleştirme performansı artırır mı?

Genelde değil ama çoğu zaman karmaşıklığı azaltır.

Bu da dolaylı olarak hata oranını düşürür.

Yani kazanç bazen hızda değil sakinlikte gelir.

Kaynaklar ve İleri Okuma

OpenCode / Agent Çalışma Mantıkları İçin Resmî GitHub Kaynağına Benzer Projelerden Biri Cline Deposu

Kubernetes RBAC Resmî Dokümantasyonu

Açıkçası, Helm Resmî Dokümantasyonu

32 Saat Geri Kazandıran Yapay Zekâ Ajanları: Gerçek Hesap:

Bu içerik işinize yaradı mı?

Benzer içerikleri kaçırmamak için beni sosyal medyada takip edin.