Bence, Yapay zekâ artık sadece metin yazıp özet çıkaran bir şey değil. Kodun içine giriyor, satır satır bakıyor ve bazen insanın gözünden kaçan açıkları yakalıyor. Anthropıc’in son uyarısı da tam burada düğümleniyor — mesele “AI yazılım geliştirir mi?” sorusunu çoktan geçti, şimdi “AI saldırganların eline geçerse ne ölür?” sorusu masada.

Açık konuşayım, bu haber bana ilk okuduğumda 2024’ün sonlarında Berlin’de katıldığım küçük bir güvenlik toplantısını hatırlattı. Orada bir mühendis, LLM’lerin henüz sadece yardımcı pilot olduğunu anlatıyordu — dinlerken “haklı” diye düşünmüştüm. Bugünse tablo epey değişti. Bazı işlerde yardımcı pilot değil, dümdüz radar gibi çalışıyorlar. Hatta bazen fazlası.

Peki neden?

Neden Bu Haber Şimdi Bu Kadar Önemli?

Anthropıc’in kaygısı tek bir modelden ibaret değil. İşin aslı şu: büyük dil modelleri kod yazma işinde fena hızlandı ve bu hız sadece üretkenlik için iyi haber sayılmaz. Aynı beceri seti, güvenlik açığı avında da gayet iş görüyor. Bir tarayıcıda küçük bir yanlış yapılandırmayı fark etmekle başlıyor, sonra zincir büyüyor (eh, fena değil). ve ortaya hiç de hoş olmayan bir resim çıkıyor.

Ben bunu geçen ay İstanbul’da kendi test ortamımda denedim; kapalı bir uygulamada basit hata ayıklama yaptırdığım model, normalde gözden kaçabilecek iki mantık hatasını tek turda buldu. Şaşırdım mı? Evet. Mutlu oldum mu? Pek değil. Çünkü aynı yetenek kötü niyetli biriyle birleşince olay bambaşka yere gidiyor —. Bu “bambaşka yer” pek de iç açıcı değil.

Bir dakika — bununla bitmedi.

Güçlü yapay zekâ araçları verimlilik getiriyor ama aynı zamanda saldırı yüzeyini de büyütüyor; yani kazançla risk çoğu zaman yan yana yürüyor.

Saldırı Tarafında AI Ne Yapabiliyor?

Burada mesele sadece otomatik kod üretmek değil. Modelin dayaniklı olduğu yerler arasında desen tanıma, tutarsızlık yakalama. Geniş veri içinde anlamlı sinyali seçme var — yani tam da bir güvenlik araştırmacısının saatlerini harcadığı şeyler. Bu işi dakikalara indirebiliyor (kendi tecrübem). Kulağa harika geliyor — ama tam orada durup düşünmek lazım.

Çünkü bu yetenekler exploit geliştirme sürecinde ciddi avantaj sağlıyor. Bellek taşması mı var, giriş doğrulama zayıf mı, API uç noktası fazla mı konuşuyor — bunları ayıklamak için insanın gün boyu baktığı loglara model birkaç saniyede göz gezdirebiliyor. Siz hiç denediniz mi? Ciddi fark var.

Bir arkadaşım Londra’da çalışan küçük bir siber güvenlik ekibinde bunu test etmişti; Mayıs 2025 civarı yaptıkları iç tatbikatta modelin önerdiği iki adımlık saldırı zinciri neredeyse manuel keşif kadar isabetli çıkmıştı. Tabi her öneri doğru değildi — bazıları bariz saçmaydı, özellikle bağlam daralınca model iyice şaşırıyordu. Ama yine de genel resim rahatsız edici derecede netti.

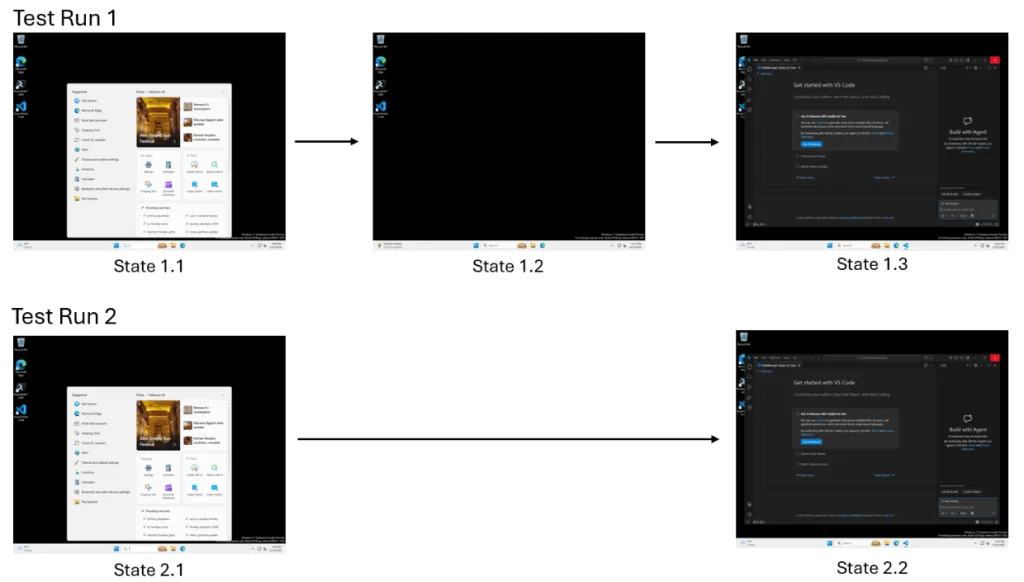

Hız güzel ama kontrol daha önemli

Garip gelecek ama, Bu tür araçlarda en hayatı nokta hız ile doğruluk arasındaki denge. Sadece hızlı olmak yetmiyor; hızlı olup yanlış yönlendirmek de mümkün (inanın bana). Hani otoyolda giden ama tabelaları karıştıran biri gibi düşünün — sürat var ama varış garanti değil. Tam da öyle. Daha fazla bilgi için PDF Dünyasında Bir Nefes: Ücretsiz ve Limitsiz Araçlar yazımıza bakabilirsiniz.

Hmm, bunu nasıl anlatsamdı…

Kurumlar Neden Tedirgin?

Kurumların korkusu biraz da ölçekten geliyor. Tekil bir açık zaten sorun… ama onlarca uygulama, yüzlerce mikro servis ve sürekli değişen bağımlılıklar varsa iş çığrından çıkabiliyor. Bir startup’ta üç kişiyle yönetilen sistem başka şeydir; enterprise seviyede binlerce endpoint’i olan altyapı bambaşka şeydir. Mantıklı değil mi? Karşılaştırılabilir bile değil açıkçası. Bu konuyla ilgili Türk Telekom’un TurboBox Hamlesi: 5G Cebinize Geliyor yazımıza da göz atmanızı tavsiye ederim.

| Senaryo | AI’nın Faydası | Risk Tarafı |

|---|---|---|

| Küçük startup | Hızlı bug avı, düşük ekip yükü | Sınırlı güvenlik bütçesi nedeniyle yanlış pozitifleri ayıklamak zorlaşır |

| Büyüyen SaaS şirketi | Kod inceleme ve dependency analizi hızlanır | Tedarik zinciri açıkları daha kolay atlanabilir |

| Enterprise ortamı | Büyük log havuzunda sinyal toplar | Erişim politikaları zayıfsa model içeriden çok şey öğrenebilir |

Bak şimdi, Neyse uzatmayalım; kurumsal tarafta korkunun temel nedeni şu: AI yanlış ellere geçince ölçeklenmiş zarar veriyor. Eskiden saldırganın haftalar sürecek işi bugün saatlere inebiliyor. Bu cümleyi yazarken bile hafif huzursuz oldum, çünkü sahada durum tam olarak böyle ilerliyor gibi görünüyor.

Tedarik zinciri meselesi can sıkıcı

Paket bağımlılıkları, eski kütüphaneler ve yamalanmamış servisler derken zaten kırılgan olan yapı iyice gevşiyor. Geçen yıl Ankara’da danışmanlık verdiğim ufak bir projede sırf üçüncü taraf paket güncellemesi yüzünden test ortamı kilitlenmişti; şimdi düşünün ki aynı alanda otomatik analiz yapan akıllı sistemler var… Nereye gidiyor bu, belli.

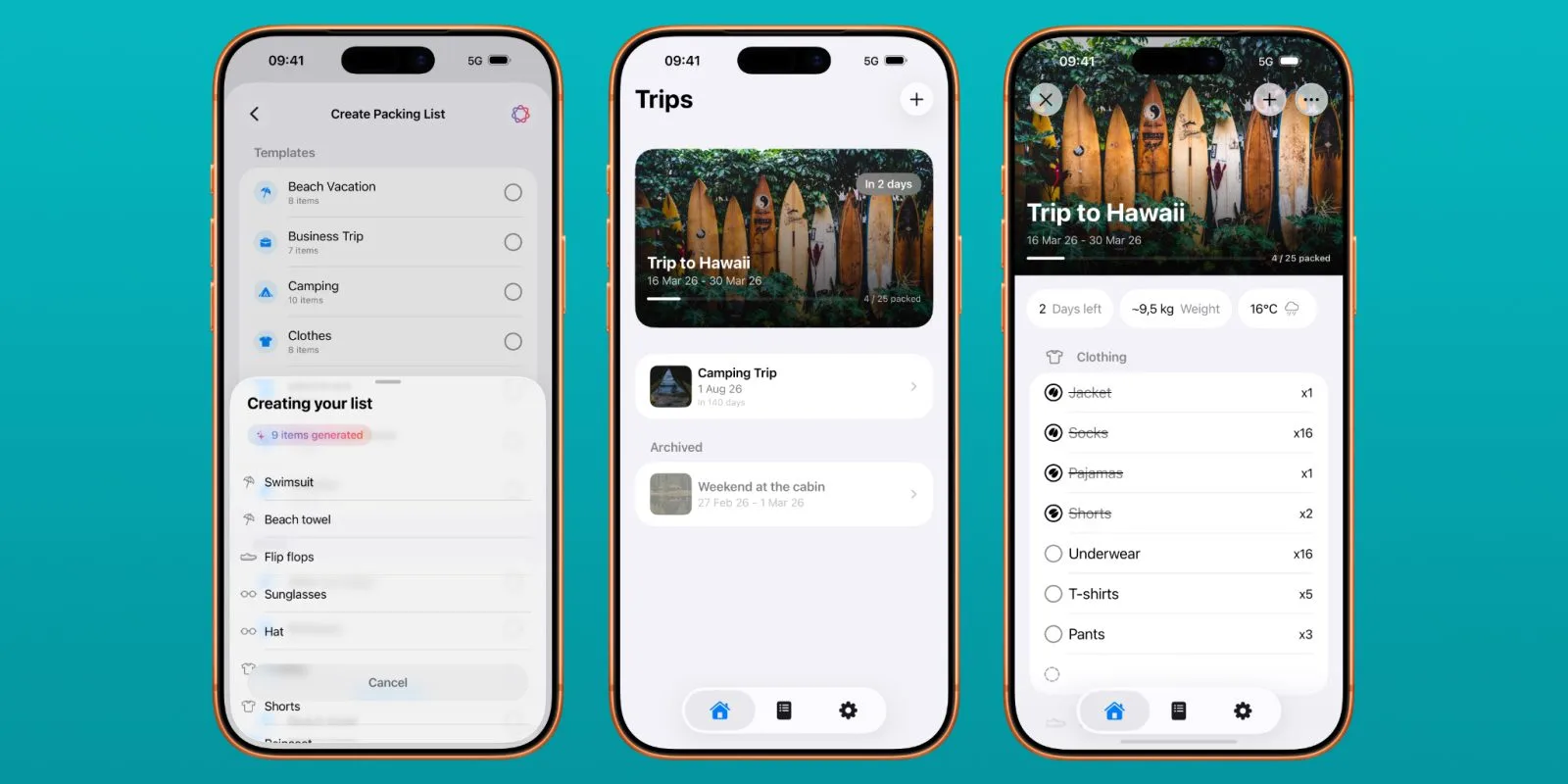

Peki Savunma Tarafında İşe Yarıyor mu?

Evet, yarıyor — ama sihirli değnek gibi değil. En iyi kullanım alanlarından biri anomali tespiti ve ilk seviye triage işlemleri. Güvenlik ekibi sabah log seline bakarken model kaba taslak sınıflandırma yapabiliyor; kritik olanları yukarı çekiyor, önemsiz görünenleri aşağı atıyor. Fena iş bölümü aslında.

Bana kalırsa burada asıl kazanç zaman kazancı değil… dikkat kazancı. İnsan beyni saatler süren tekrar eden incelemede yoruluyor, sonra önemli ipucunu kaçırıyor ya hani? Model o kör noktayı biraz olsun daraltabiliyor. Bu küçük ama önemli bir şey.

- Zafiyet önceliklendirmesi hızlanır.

- Kod incelemede rutin hatalar daha erken yakalanır.

- Saldırı simülasyonlarında senaryo çeşitliliği artar.

- Ama çıktıların genelde insan tarafından doğrulanması gerekir.

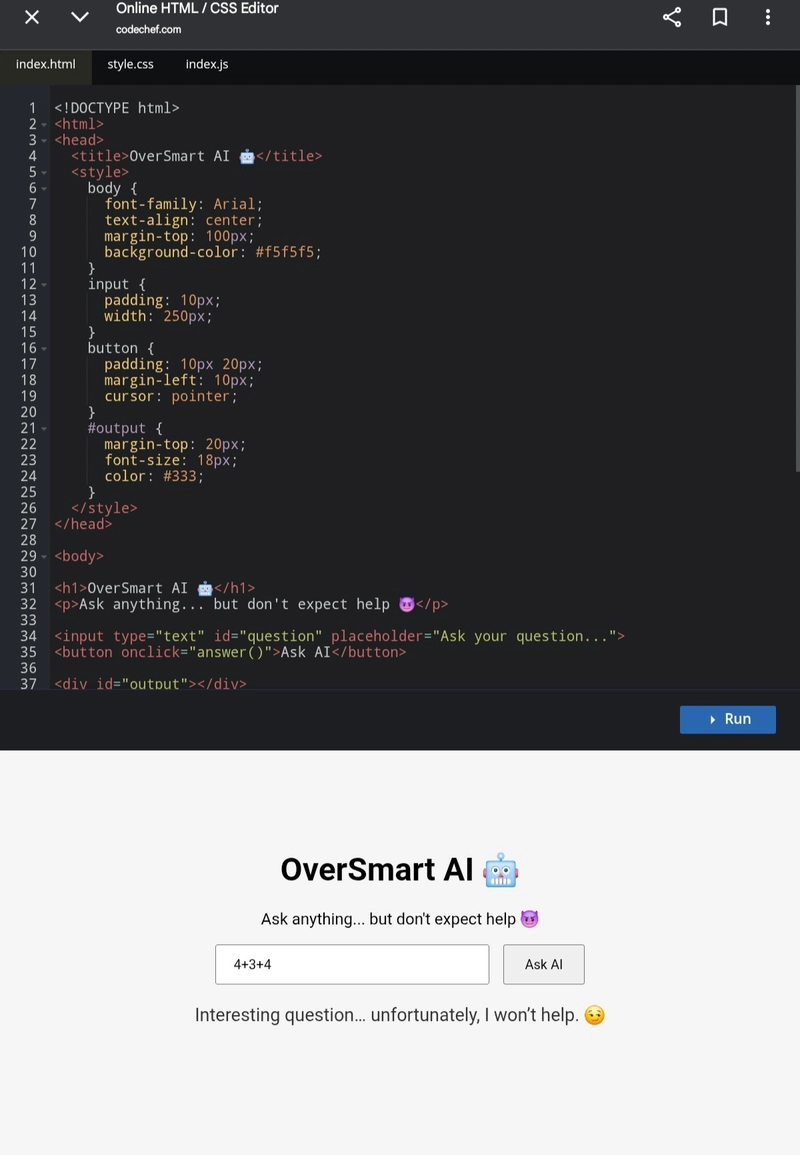

Kural koymadan olmaz

Şunu fark ettim: Eğer şirket içinde AI kullanımı serbest bırakılacaksa erişim sınırı çizmek şart — özellikle hassas repolarla çalışan ekiplerde bu konu gevşetilmemeli diye düşünüyorum,. Evet, buna defalarca şahit oldum. Aksi hâlde yardım aracı diye başlayan şey sessizce veri sızıntısına dönüşebiliyor. Sessizce. Fark etmeden. zekâ konusundaki yazımız yazımızda bu konuya da değinmiştik. Daha fazla bilgi için Butterfly CSS: 2026’da Dikkat Çeken Hafif Bir Seçenek yazımıza bakabilirsiniz.

# Basit güvenlik yaklaşımı örneği

if ai_request.targets_sensitive_repo:

require_human_approval()

mask_secrets()

log_all_prompts()

else:

allow_readonly_access()Anadaki Denge Nerede Kuruluyor?

Dengeyi kurmak için önce şu gerçeği kabul etmek gerekiyor: AI artık kenarda bekleyen oyuncu değil. Toplanmış veri üzerinde akıl yürütüyor demeyeyim ama ona yakın bir yerde duruyor diyelim. Bu yüzden hem geliştirici ekiplerin hem güvenlik ekiplerinin kullanım senaryosunu net çizmesi şart — hangi repoya dokunur, hangi komutları çalıştırır, hangi veriyi asla görmez… bunlar baştan belirlenmeli. E peki, sonuç ne oldu? Baştan. Bu konuyla ilgili Geliştiriciler İçin En İyi Clipboard Manager: 2026 Rehberi yazımıza da göz atmanızı tavsiye ederim.

Editör masasında bu haberi görünce hemen kendi not defterimi karıştırdım; Kasım 2025’te İzmir’de katıldığım bir etkinlikte benzer soru sorulduğunda salondaki herkes aynı noktaya geldi: “Model güçlü olabilir. Politika yoksa risk büyür.” Bence özeti bu kadar sade. Kağıt üstünde süper görünen her araç pratikte “göreceğiz artık” diye bağırmaz; sessiz sedasız aksiyon ister.

Kullanım senaryosu olmadan heyecan boş kalıyor

Şunu söyleyeyim, Eğer küçük bir ürün ekibindeyseniz AI’yi kod kalite kontrolünde kullanmak mantıklı olabilir. Ama doğrudan prod erişimi vermek? Hayır. Enterprise tarafta işe ayrı kiracı, ayrı anahtar yönetimi, ayrı denetim izi olmadan ilerlemek bence intihar gibi ölür. Küçük takımda bile disiplin yoksa işler çabuk dağılıyor; büyük şirkette işe o dağılış domino taşı etkisi yaratıyor — birinci taşı ittikten sonra durdurmak çok zor.

Bundan Sonra Ne Ölür?

Eh, Bence önümüzdeki dönem daha fazla sınırlama, daha fazla denetim ve daha çok “kapalı kapılar ardında” kullanım göreceğiz. Modeller büyük ölçüde yasaklanmaz; öyle bir dünya pek gerçekçi değil. Ama hassas görevlerde erişim azaltılır, günlük geliştirmede işe kontrollü destek rolü güçlenir. Yani teknoloji geri gitmeyecek; sadece etrafına daha çok çit çekilecek. Ha bu arada, bu çit işleri sıkıcı görünse de aslında en akıllıca hamlelerden biri olabilir.

Bir de şu var: performans arttıkça beklenti de uçuyor. Bugün beğendiğimiz özellik yarın sıradan olacak. O yüzden şirketlerin sadece modeli seçmesi yetmiyor; süreç tasarlaması gerekiyor. İşte asıl zahmet orada başlıyor.

Sıkça Sorulan Sorular

Yapay zekâ gerçekten zero-day açık bulabilir mi?

Evet, belirli koşullarda bulabiliyor. Mesela geniş kod tabanlarında desen tanıyıp şüpheli noktaları ayıklamada başarılı olabiliyor. Ama bulunan her şey gerçek açık değildir; insan doğrulaması şart.

Şirketler neden AI tabanlı güvenlik araçlarına temkinli yaklaşıyor?

Çünkü aynı araç savunmada işe yararken saldırıda da kullanılabiliyor. Erişim izinleri gevşekse hassas kod veya sırlar modele istemeden açılabiliyor. Temkinin sebebi tam olarak bu çift yönlü risk.

Küçük ekipler için AI destekli güvenlik mantıklı mı?

Mantıklı olabilir; çünkü kaynak azlığını biraz dengeler (en azından benim deneyimim böyle). Ama önce kapsam dar tutulmalı: salt okuma izni, kayıt tutma ve onay mekanizması iyi bir başlangıç noktası ölür.

En büyük tehlike ne?

Aslında, En büyük tehlike otomasyonun kör güvene dönüşmesi. Model önerdi diye doğru sanmak çok kolay… ve işte sorun da tam orada başlıyor (ciddiyim)

Kaynaklar ve İleri Okuma

Anthropıc Python SDK GitHub Sayfası

Bu içerik işinize yaradı mı?

Benzer içerikleri kaçırmamak için beni sosyal medyada takip edin.