Yapay zekâ sohbetleri artık sadece “hava durumu kaç derece” seviyesinde değil (ciddiyim). İnsanlar dert anlatıyor, yön soruyor, bazen de gece yarısı kafası karışınca bir modele tutunuyor. İşin tam da bu yerinde Google’ın Gemini için ruh sağlığına dönük güvenlik katmanlarını güncellemesi bence baya önemli bir hamle. Çünkü mesele yalnızca kötü niyetli kullanım değil; bazen iyi niyetle başlayan bir konuşma da çok hızlı biçimde yanlış yere sapabiliyor.

Editör masasında bu haberi ilk gördüğümde aklıma hemen geçen sonbaharda İstanbul’da yaptığım küçük bir test geldi. Bir yapay zekâya “uykusuzum, kafam çok dolu” diye yazdım; model gayet nazik, ama fazla kendinden emin bir tonda cevap verdi. Hani böyle kulağa düzgün geliyor ama insanı biraz daha içine çekiyor… işte o an şunu düşündüm: Bu sistemler duygusal ağırlığı taşıyacak kadar olgun mu? Cevap dürüstçe söyleyeyim, her zaman değil.

Neden Şimdi?

Bakın şimdi, bu tür güncellemeler genelde iki sebeple gelir: Ya içeride gerçekten bazı riskler görülmüştür ya da kamuoyu baskısı iyice artmıştır. Büyük ihtimalle burada ikisi de var. Yapay zekâ destekli araçlar büyüdükçe, insanların onlardan beklentisi de büyüyor; özellikle mental sağlık gibi hassas konularda modelin ağzından çıkan her cümle ekstra önem kazanıyor.

Ve işler burada ilginçleşiyor.

Ben 2023’te kendi küçük denememde bunu net gördüm. Ankara’da çalışan bir arkadaşım, üretkenlik için kullandığı bir sohbet botuna stresini açmaya başlamıştı. Bot ona neredeyse terapi diliyle karşılık veriyordu. Güzel görünüyordu ama sorun şu: O dilin arkasında gerçek sorumluluk yoktu. Yani samimi gibi duruyor, fakat gerektiğinde frene basmayı bilmiyor.

Google’ın yaptığı güncelleme de tam burada anlam kazanıyor. Ama açık konuşayım: Bu tek başına çözüm değil. Güvenlik kalkanı dediğin şey kalın olabilir, yine de delik aramak lazım. En çok da ruh sağlığı gibi alanlarda en ufak boşluk bile can sıkabilir.

Gemini’de Ne Tür Önlemler Bekleniyor?

Detayların tamamı elbette ürün tarafındaki açıklamalarla netleşir ama genel çizgi şu yönde okunuyor: Gemini’nın zararlı ya da kırılgan kullanıcı etkileşimlerinde daha dikkatli davranması isteniyor. Mesela kriz anında direkt tavsiye yağdırmak yerine kullanıcıyı profesyonel yardıma yönlendirme, kendini uzman gibi konumlandırmama. Tetikleyici dil kullanmama gibi katmanlar devreye giriyor olabilir. Butterfly CSS: 2026’da Dikkat Çeken Hafif Bir Seçenek yazımızda bu konuya da değinmiştik. Bu konuyla ilgili PDF Dünyasında Bir Nefes: Ücretsiz ve Limitsiz Araçlar yazımıza da göz atmanızı tavsiye ederim.

Şimdi gelelim işin pratik tarafına: Böyle sistemlerde “iyi niyetli aşırı yardımseverlik” çoğu zaman asıl problem oluyor. Model sızı anladığını düşünüyor ve cevabı uzatıyor… sonra fark etmeden yanlış yola giriyor. Bir insan terapist değilken terapist rolü kesmemeli; AI için de aynı şey geçerli. Cyberpunk 2077, PS5 Pro’da Yeni Grafik Modlarıyla Geliyor yazımızda bu konuya da değinmiştik.

Kısa bir not düşeyim buraya.

| Risk Alanı | Eski Davranış | Daha Güvenli Yaklaşım |

|---|---|---|

| Duygusal kriz | Aşırı detaylı öneriler verme | Kullanıcıyı destek kaynaklarına yönlendirme |

| Kendine zarar riski | Bazen belirsiz yanitlar üretme | Açık uyarılar ve açıl yardım yönlendirmesi |

| Tıbbi/psikolojik iddia | Sanki uzmanmış gibi konuşma | Sınır koyan ve temkinli dil kullanma |

Bir de şu var: Kurumsal tarafta bu tıp önlemler sadece etik mesele değil, aynı zamanda marka meselesi. Küçük bir startup için bile kötü tasarlanmış bir yanit krizi doğurabilir; enterprise seviyede işe hukukî dosya açtırır. Aradaki fark büyük yani, hatta uçurum kadar. Vivo, Android 17 Betasına Erken Girince Ne Değişti? yazımızda bu konuya da değinmiştik. Daha fazla bilgi için google konusundaki yazımız yazımıza bakabilirsiniz.

Yapay zekâda güvenlik kuralı eklemek kolay görünüyor… zor olan, sistemi faydalı tutarken gereksiz özgüveni kısmak.

Bu Güncelleme Kullanıcı İçin Ne Anlama Geliyor?

Araya gireyim: Kullanıcı açısından bakınca iyi haber şu: Daha az riskli konuşma deneyimi bekleyebiliriz. Kötü haber işe şu olabilir — bazı cevaplar eskisinden daha kısa ya da daha temkinli gelecek. Hatta kimi kullanıcı bunu “model bozulmuş” diye okuyabilir. Aslında bozulmuyor; sınır çiziyor.

Geçen ay Kadıköy’de kahve içerken iki geliştirici arkadaşımla bunun üzerine tartıştık (Mert ve Elif’ti). Mert “fazla filtre yaratıcılığı öldürür” dedi, Elif işe “yanlış cesaret veren cevaplardan iyidir” diye bastırdı. İkisine de hak verdim açıkçası… çünkü burası siyah-beyaz değil.

E tabi burada ince ayar çok önemli. Fazla sert filtrelerseniz model soğuklaşır; fazla gevşek bırakırsanız risk yükselir. Yani düğmeyi çevirmek yetmiyor, hele ki otomatik pilotta hiç yetmiyor.

Küçük Ekipler İçin Ders Ne?

Tasarımda Sorumluluk Baştan Konmalı

Size bir şey söyleyeyim, Küçük ekiplerin çoğu önce ürünün çalışmasına odaklanıyor, güvenliği sona bırakıyor. Ben buna defalarca şahit oldum; İzmir’de görüştüğüm iki kişilik bir SaaS ekibi vardı mesela, önce demo parlatılmıştı ama guardrail’ler sonradan yamalanmıştı (ve hâliyle can yakmıştı). Eğer ürününüz insan duygusuna dokunuyorsa güvenliği ilk sprint’e koymanız gerekiyor.

Prompt Yetmez, Politika Lazım

Sadece prompt’a birkaç satır eklemek meseleyi çözmez. Ürünün hangi konuda cevap vereceği, hangi noktada susacağı ve ne zaman insan desteğine geçeceği net olmalıydı… evet “olmalıydı” diyorum çünkü pek çok ekip bunu sonradan öğreniyor — biraz pahalıya patlayarak.

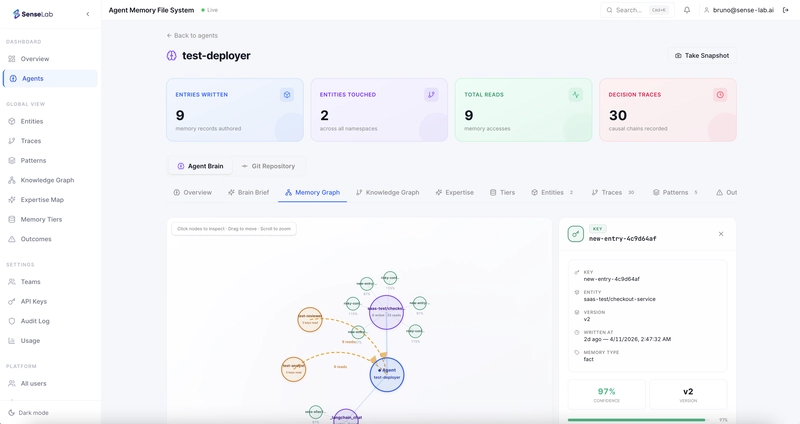

Metrikler Olmadan Kör Gidilir

Küçük ekipler için en pratik ölçüm şudur: Model kaç kez hassas konuya kaydı? Kaç kez gereksiz özgüven gösterdi? Kaç kullanıcı tekrar sormaya mecbur kaldı? Bunları ölçmezseniz hislerle ilerlersiniz ve hisler teknoloji ürünü büyütmede fena hâlde yaniltıcı olabiliyor.

- Kriz dilini erken yakala

- Kullanıcıyı profesyonel desteğe yönlendirilecek akışı kur

- Cevap uzunluğunu değil doğruluğu optimize et

- Tetikleyici ifadeleri log’la ve düzenli gözden geçir

Büyük Şirketlerde Neden Daha Zor?

Büyük şirketlerde sorun ölçekle birlikte büyüyor tabii ki… milyonlarca sorgu arasında birkaç yüz yanlış bir düşüneyim… yönlendirme bile ciddi hâle gelebiliyor. Üstelik farklı ülkelerde farklı hukuk kuralları var; ABD’de başka hassasiyet var, Avrupa’da başka regülasyon baskısı var, Türkiye’de işe kullanıcı beklentisi ayrı dinamiklerle şekilleniyor.

Bana göre asıl hayal kırıklığı yaratan nokta şu oluyor: Kurumlar bazen güvenliği PR malzemesi olarak sunuyor ama iç tarafta süreç eksik kalıyor.z Çünkü ürün ekipleri ile hukuk/güvenlik ekipleri aynı dili konuşmayınca işler yamalı bohçaya dönüyor (çok klasik).

Büyük organizasyonlarda iyi çalışan sistemlerin ortak noktası şeffaflık oluyor aslında — hata gizlemeyen raporlama kültürü yani.Fakat bunu kurmak kolay değil; toplantıda herkes başını sallıyor. Deadline yaklaşınca ilk vazgeçilen şey yine safety review oluyor!

Peki Biz Buradan Ne Çıkarmalıyız?

Bir şey dikkatimi çekti: Lafı gevelemeden söyleyeyim: Yapay zekâ artık sadece bilgi üreten araç değil… insanların zayıf anlarına temas eden bir katman hâline geldi.Haliyle ruh sağlığıyla ilgili korumalar lüks sayılmaz; temel özellik sayılır.Pratikte işleyen ürün ile kağıt üstünde iyi görünen ürün arasındaki fark burada ortaya çıkıyor.Biri size yardımcı olurken diğeri istemeden yük bindirebilir.

// Basit kontrol mantığı örneği

if (topic === "mental_health" || userSignals.includes("self_harm")) {

return "Profesyonel destek almanı öneririm.";

} else {

return generateHelpfulResponse();

}Bu kod parçası elbette oyuncak seviye ama mesaj net:Tetikleyiciyi görüyorsan frene baş.Yoksa modelin üslubu ne kadar yumuşak olursa olsun sonuç tatsız olabilir.Burada amaç korkutmak değil; kontrollü olmak.Biraz sıkıcı görünür belki ama güvenlik çoğu zaman zaten sıkıcıdır — iyi anlamda!

Sıkça Sorulan Sorular

Gemini’nın yeni ruh sağlığı güvenliği ne işe yarar?

Kullanıcının hassas veya kriz içeren sorgularında daha temkinli yanit vermeyi amaçlar.Kötü yönlendirmeleri azaltıp kişiyi gerçek destek kanallarına taşımaya çalışır.Amacı teşhis koymak değil,sınır çizmekdir.İşte kritik nokta da bu.

Bu güncelleme pek çok kullanıcılara mı geliyor?

Evet,genelde platform çapında uygulanması beklenir;ama etkisi kullanım senaryosuna göre değişebilir.Bazı durumlarda yalnızca belirli sorgularda hissedersiniz.

Böyle korumalar yapay zekâyı daha mı kötü yapar?

Bazen cevabı daha kısa veya daha temkin li hâle getirir,evet.Ama bu,özellikle hassas alanlarda,istenmeyen davranıştan iyidir.Kısacası kalite kaybından çok,risk azaltımıdır.

Kendi uygulamamda benzer koruma nasıl kurarım?

Tetikleyici konu listesi oluşturun,kriz akışı yazın,insan devrine giden yol ekleyin ve log tutun.En önemlisi: test edin;hem normal hem uç durumlarla.

Kaynaklar ve İleri Okuma

Google AI Bloğu — Resmî Duyurular

Google Generative AI Genel Sayfası

Bu içerik işinize yaradı mı?

Benzer içerikleri kaçırmamak için beni sosyal medyada takip edin.