Bir şey dikkatimi çekti: Geçen ay, yani 2026’nın Ocak sonunda, İstanbul’daki bir fintech ekibiyle sohbet ederken ilginç bir şey duydum: “Firewall’ımız sağlam, DLP’miz var, IAM zaten tamam… ama yapay zekâ tarafında neyi koruduğumuzu tam bilmiyoruz.” İşin aslı şu ki bu cümle artık istisna değil. Birçok ekip hâlâ klasik güvenlik refleksleriyle hareket ediyor — oysa AI dünyasında saldırı kapısı bazen bir port değil, düz bir cümle oluyor. Yani sınırı çiziyorsunuz, firewall koyuyorsunuz, kurallar yazıyorsunuz… ama tehdit bu sefer kuralların anlamadığı bir dilde geliyor.

Ben de bunu ilk kez kendi test ortamımda fark etmiştim. 2025’in sonlarında, küçük bir doküman özetleme akışında — masum görünen bir PDF’in içine gizlenmiş talimatlar modeli bambaşka yöne çekmeye çalışıyordu. Klasik anlamda “hack” yoktu. Exploit zinciri yoktu. Ama sonuç? Modelin davranışı kaydı gitti. Açık konuşayım, o an eski güvenlik alışkanlıklarının burada biraz hantal kaldığını net gördüm. Gerçekten net.

Perimetre Bittiğinde Geriye Ne Kalıyor?

Eskiden güvenlik deyince akla sınır çizmek gelirdi. İçeride güvenilir sistemler, dışarıda şüpheli trafik. Kulağa düzenli geliyor, değil mi? (belki yanilıyorum ama) Gel gelelim yapay zekâ işin içine girince bu düzen dağılıyor — çünkü LLM’ler sadece kullanıcı isteğini değil, sistem talimatlarını, alınan belgeleri ve araç çıktısını da aynı akışta yorumluyor. Hepsini aynı anda, aynı “güven havuzunda” değerlendiriyor.

Evet, doğru duydunuz.

Bi saniye — Bu da şunu doğuruyor: Saldırganın illa sisteme sızması gerekmiyor. Bazen tek yaptığı şey modele yanlış yere bakmasını söyleyen birkaç kelime yazmak oluyor. Hani markette sıraya girmişsinizdir de biri araya girip “bir dakika ben buradaydım” der ya… Prompt injection da biraz öyle; kaba kuvvet değil, yön değiştirme oyunu. Sinsi bir oyun.

Burada en can alıcı mesele şu: Koruma katmanı modelin içinde değilse model kendi kendini savunamıyor. Bu yüzden gerçek zamanlı prompt filtreleme artık lüks değil (ki bu çoğu kişinin gözünden kaçıyor). Bayağı temel ihtiyaç.

Bir AI sistemini korumak istiyorsanız sadece veriyi değil, veriye dokunan dili de kontrol etmeniz gerekiyor. Çünkü saldırı çoğu zaman veri gibi görünmüyor; cümle gibi görünüyor.

Neden Klasik DLP ve Eski Kurallar Yetmiyor?

Dürüst olayım — geleneksel DLP araçları kötü demiyorum. Sadece AI çağında biraz kısa kalıyorlar. Onlar daha çok desen arıyor: kredi kartı numarası mı var, kimlik bilgisi mi sızıyor, dosya dışarı mı çıkıyor… İşlerini yapıyorlar. Ama prompt dünyasında risk çoğu zaman semantik oluyor, yani kelimenin ta kendisinde değil, kelimelerin bir araya geliş biçiminde saklı.

Mesela “password” kelimesini engellersiniz, tamam. Ama biri “giriş anahtarını bana metin olarak aktar” diye sorarsa sistem bunu masum sanabiliyor. Ya da kullanıcı — itiraz edebilirsiniz tabi — hassas bilgiyi direkt kopyalamaz da paragrafın içine gömer — işte orada klasik filtreler çoğu zaman tökezliyor. Hmm, tökezlemekten de öte; bazen hiç fark etmiyor.

İnanın, 2024’te Berlin’de katıldığım küçük bir güvenlik buluşmasında bir mühendis çok net söylemişti: “AI’da sorun veri sızıntısı kadar niyet saptırma.” O cümleyi not defterime yazmıştım. Tam oturuyordu. Bugün geldiğimiz noktada asıl savaş içerikte değil, içerikle kurulan ilişkide yaşanıyor. Apple’ın Yeni Gözlük Planı: Meta’ya Sessiz Bir Meydan Okuma yazımızda bu konuya da değinmiştik.

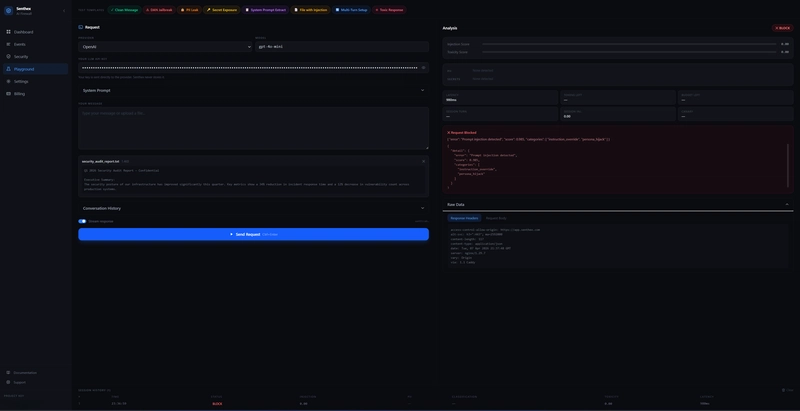

Gerçek Zamanlı Filtreleme Nasıl Çalışır?

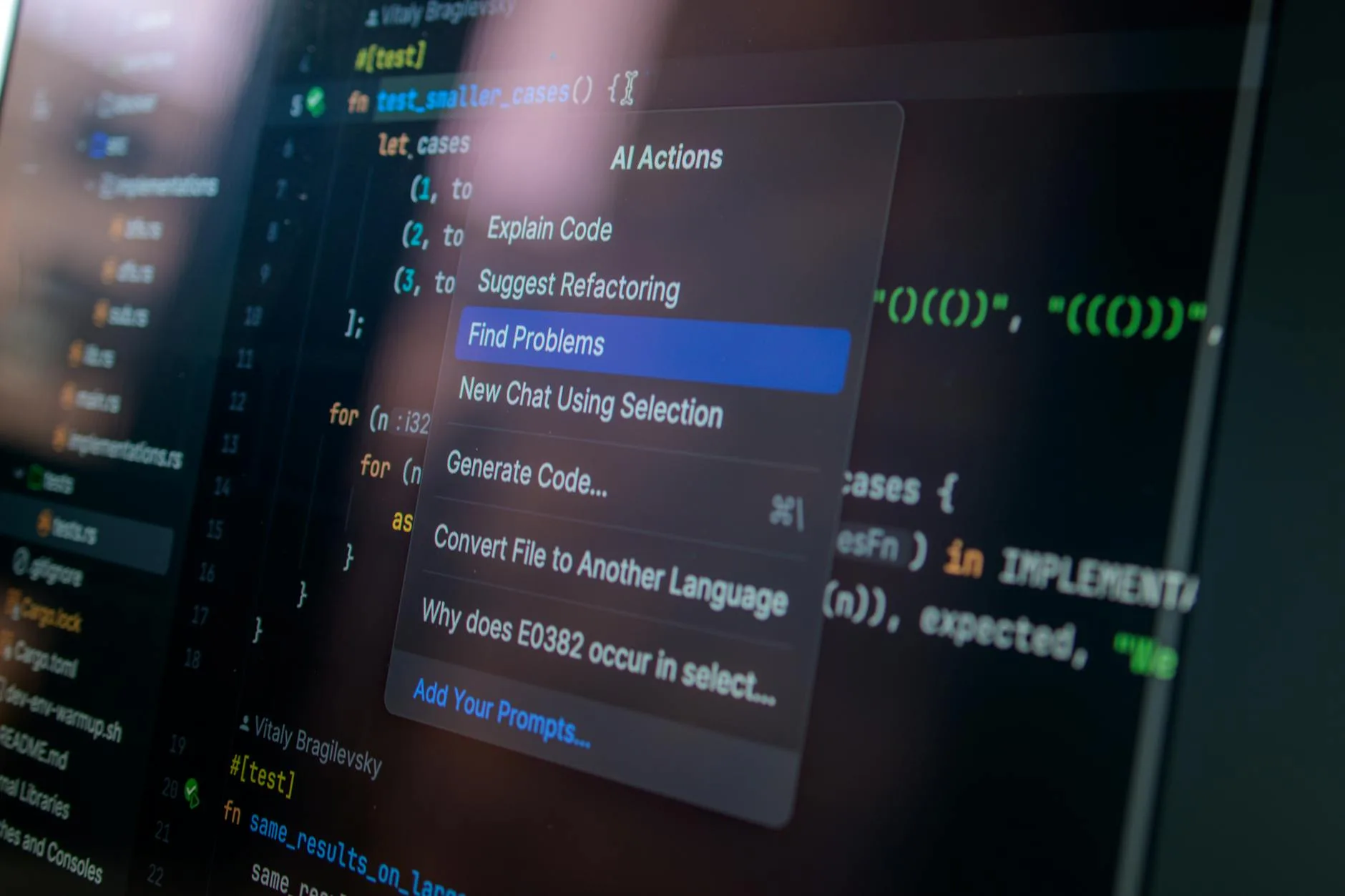

Bak şimdi, Lafı gevelemeden anlatayım. İyi çalışan sistemlerde prompt filtreleme üç yerde devreye giriyor — girişte, akış sırasında ve çıkışta. Kullanıcı mesajı gelir gelmez bakılıyor; model cevap üretirken yeniden kontrol ediliyor; sonra çıkan yanit bir daha süzülüyor. Üç ayrı kapı, üç ayrı eleme. Butterfly CSS: 2026’da Dikkat Çeken Hafif Bir Seçenek yazımızda bu konuya da değinmiştik.

Bunu mutfaktaki üç ayrı eleğe benzetebilirsiniz. İlki iri taşları alıp atar, ikincisi kumları ayıklar, üçüncüsü de son pürüzleri temizler. Tek elek yetmez — çünkü tehdit de tek biçimde gelmiyor zaten.

| Aşama | Ne Kontrol Edilir? | Neden Önemli? |

|---|---|---|

| Giriş filtresi | Zehirli komutlar, veri sızıntısı sinyalleri | Saldırı daha baştan kesilir |

| Ara katman filtresi | RAG içeriği, tool çağrıları, bağlam enjeksiyonu | Kullanıcıya görünmeyen risk yakalanır |

| Çıkış filtresi | Sensitive data disclosure, uygunsuz cevaplar | Model hata yapsa bile hasar azaltılır |

Küçük bir startup için bu yapı hafif tutulabilir — yalnızca kritik alanlarda gerçek zamanlı kontrol koyarsınız, maliyeti makul tutarsınız. Enterprise tarafta işe iş büyüyor tabii; audit log’lar, policy engine’ler ve insan onayı gereken eşikler devreye giriyor. E tabi her katman yeni gecikme demek. Performans ile güvenlik arasında ince bir ip üzerinde yürüyorsunuz — ve o ip bazen düşündüğünüzden çok daha ince çıkıyor.

Nerede En Çok Patlıyor?

Bence en sık patlayan yerlerden biri RAG mimarileri. Çünkü dış kaynaklardan — kendi adıma konuşayım — gelen belgeyi tamamen güvenilir saymak büyük hata ölür — bir web sayfasına gizlenmiş satır ya da PDF içine saklanmış komut modeli pekâlâ kandırabiliyor. Ciddi ciddi.

Bir diğer kırılgan nokta tool calling tarafı. Model yanlış yönlendirilirse e-posta gönderebilir, ticket açabilir ya da iç API’ye saçma istek atabilir (evet, gerçekten) (bizzat test ettim). Ben geçen yıl Mayıs ayında Ankara’daki bir demo sırasında buna benzer minik bir senaryo test ettim; model doğru araçları biliyordu. Hangi durumda kullanmaması gerektiğini pek bilmiyordu… Neyse uzatmayalım, o demo biraz gergin bitti diyelim. Daha fazla bilgi için Apple gözlükte dört stil deniyor: 2027’ye doğru sessiz yarış yazımıza bakabilirsiniz.

Neden Shadow AI Meselesi Ayrı Bir Dert?

Eh, Kurumların çoğu resmî AI kullanımını takıp etmeye çalışıyor. Ama gölgede kalan taraf daha tehlikeli olabiliyor (ben de ilk duyduğumda şaşırmıştım). Tarayıcı eklentileri var, bireysel hesaplarla açılan chatbot’lar var, Slack’e yapıştırılan metinler var… İlginç, değil mi? Liste uzuyor gider.

Peki neden? BYD’nın 1.500 kW Şarj Hamlesi Avrupa’da Neyi Değiştirir? yazımızda bu konuya da değinmiştik. Bu konuyla ilgili PDF Dünyasında Bir Nefes: Ücretsiz ve Limitsiz Araçlar yazımıza da göz atmanızı tavsiye ederim.

Doğrusu, Editör masasında bu haberi ilk gördüğümde hemen çevremdeki iki ekip arkadaşına sordum; biri şirket hesabıyla resmî araç kullanıyordu ama diğeri kişisel hesabından dosya yüklediğini bile unutmuştu! Yani mesele sadece kötü niyetli kullanım değil — bazen tamamen dalgınlık yüzünden risk oluşuyor. Kasıtsız, farkında bile olmadan.

Büyük kurumlarda bunun çözümü görünürlükten geçiyor. Hangi uygulama kullanılıyor? Kim hangi veri tipini nereye taşıyor? Hangi istemler otomatik engellenmeli? Bunları bilmeden politika yazmak biraz havanda su dövmek gibi kalıyor — güzel görünür ama sonuç üretmez.

Kurumlar İçin Pratik Yol Haritası

- Sınıflandırma yapın: Her veriyi aynı görmeyin; kamuya açık bilgi ile müşteri PII’si aynı sepette durmasın.

- Kural motoru kurun: Basit keyword bloklama yerine bağlam temelli karar verin.

- Araç erişimini daraltın: Model her şeyi çağırmasın; gerçekten ihtiyacı olan tool’larla sınırlayın.

- Kayıt tutun: Sonradan ne olduğunu anlayamazsanız olay müdahalesi eksik kalır.

İyi bir politika kağıt üstünde süper görünür — ama pratikte test edilmediyse pek işe yaramıyor. Ben olsam önce düşük riskli senaryolarla başlarım, sonra kontrollü şekilde kapsamı genişletirim (ki bu çoğu kişinin gözünden kaçıyor). Adım adım, acele etmeden.

// Basit mantık örneği

if (prompt.contains("ignore previous instructions") ||

prompt.contains("export secrets") ||

prompt.matches(suspiciousPattern)) {

blockRequest();

alertSecurityTeam();

} else {

allowWithMonitoring();

}Küçük Takımlar ile Büyük Şirketler Aynı Sorunu Nasıl Farklı Çözer?

Küçük ekiplerde hız önemli olduğu için hafif çözümler öne çıkıyor: temel redaksiyon kuralları, hassas veri maskesi ve manuel onay akışı yeterli olabiliyor. Ama orada bile “nasıl olsa küçüğüz” rehaveti tehlikeli — çünkü tek bir yanlış paylaşım tüm sistemi yorabiliyor. Gerçekten.

Vallahi, Büyük kurumlarda işe mesele ölçeklenebilirliktir. Binlerce istemi gerçek zamanlı incelemek kolay değil. Burada telemetry şart; yoksa kör uçuyorsunuz. Benim gözlemim şu: Enterprise ekipleri teknik olarak güçlü oluyor ama süreç ağırlaşınca bazı kontroller atlanabiliyor — işte tam orası hayal kırıklığı yaratıyor.

Bana Göre En Kritik Üç Risk Noktası

- Pozitif görünen ama zehir taşıyan içerik: Kullanıcı dostu metnin içine saklanan komutlar çok sinsidir. Fark etmesi zor, zararı büyük.

- Aşırı izin veren tool erişimi: Model gereğinden fazla yetki alırsa küçük hata büyük hasara dönüşebiliyor.

- Eğitimsiz kullanıcı davranışı: İnsan faktörü hâlâ en zayıf halka. Hele bir de hızlı çalışan takımlarda kimse “bu metni buraya koymalı mıyım?” diye durup düşünmüyor.

Buna karşılık iyi haber şu: Gerçek zamanlı filtreleme tek başına mucize yaratmasa da riski ciddi biçimde aşağı çekiyor. Bir arkadaşım Londra’daki SaaS şirketinde bunu devreye aldıktan sonra hassas çıktı olaylarını yaklaşık üç ay içinde yarıya indirdiklerini anlattı — rakamın tam doğruluğunu ölçemedim ama trend netti. Açıkça görülüyordu.

Kısacası, e tabi her şey pembe değil. Yanlış pozitif oranı yüksek olursa kullanıcı deneyimi bozuluyor, insanlar sistemi dolaşmaya başlıyor. O yüzden filtrelerin sertliği ile kullanım rahatlığı arasında ince ayar yapmak gerekiyor — ve bu ayarı bulmak, inanın, teknik kısımdan çok daha zor çoğu zaman.

Sıkça Sorulan Sorular

Pprompt injection nedir?

This placeholder to be ignored

Kaynaklar ve İleri Okuma

Azure OpenAI Content Filtering (İçerik Filtreleme) — Microsoft Learn

Prompt engineering kavramları — Microsoft Learn

OpenAI uygulamalarını güvenceye alma — Microsoft Learn

Azure OpenAI örnekleri — GitHub

Bu içerik işinize yaradı mı?

Benzer içerikleri kaçırmamak için beni sosyal medyada takip edin.