Yapay zekâ dünyasında rüzgâr bir süredir hep aynı yönden esiyordu: daha büyük modeller, daha çok veri, daha fazla kullanım senaryosu. Ama işin aslı şu — bir noktada “hız” tek başına yetmiyor. Florida Başsavcılığı’nın OpenAI’ye dönük incelemesi tam buraya çarpıyor. Konu sadece ChatGPT’nın ne kadar akıllı olduğu değil; ulusal güvenlik, çocuk güvenliği ve bu sistemlerin sahada nasıl kullanıldığı da masanın üstünde.

Açık konuşayım — ben bu tür soruşturmaları görünce iki duygu arasında gidip geliyorum. Bir yanda “nihayet biri sorumluluk tarafını da konuşuyor” hissi var, öte yanda “umarım iş büyük ölçüde politik şova dönmez” kaygısı. 2024 sonbaharında İstanbul’da bir etkinlikte sohbet ettiğim bir güvenlik mühendisi bana aynen şunu demişti: “Model iyi olabilir ama çevresindeki kontrol katmanı zayıfsa ortada akıllı sistem değil, hızlı risk dağıtıcısı oluyor.” Florida’nın baktığı yer de biraz orası gibi aslında.

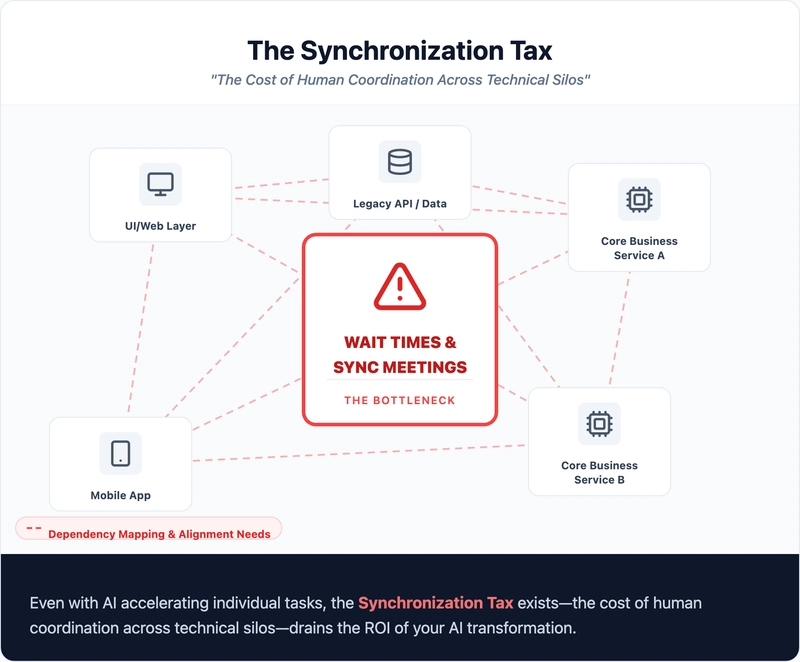

Bunu yaşayan biri olarak söyleyeyim, Gel gelelim bu mesele sadece OpenAI’ye sıkışmış bir tartışma değil. Sektörün tamamının canını sıkan ortak bir düğüm var: tüketiciye sunulan AI ürünleri ile regülasyonun yetişme hızı arasında koça bir makas oluştu. Bu makas kapanmadıkça her eyalet, her ülke kendi refleksini veriyor — kimi teşvik ediyor, kimi frene basıyor, kimi de doğrudan dosya açıyor.

Dosyanin merkezinde ne var?

İki ana başlık var: güvenlik ve etki alanı. Güvenlik derken yalnızca klasik siber güvenliği düşünmeyin — burada çocukların maruz kalabileceği içerikler, zararlı yönlendirmeler. Modelin ikna gücü de işin içine giriyor. Çünkü yapay zekâ bazen arama motoru gibi davranmıyor. Daha çok sabırlı bir sohbet arkadaşı gibi davranıyor (şaşırtıcı ama gerçek). İşte tehlike biraz burada başlıyor.

Evet, doğru duydunuz.

Ulusal güvenlik tarafında işe mesele çok daha geniş. Büyük dil modelleri yanlış ellere geçtiğinde propaganda üretiminden sosyal mühendisliğe kadar uzanan oldukça kirli işler çıkabiliyor. 2023’te küçük bir kurumsal projede benzer bir tartışma yaşamıştık; ekip içinden biri “model. Metin yazıyor, ne olacak?” demişti. Sonra bir hafta içinde test ortamında üretilen örnek phishing metni o kadar inandırıcı çıktı ki herkesin yüzü değişmişti —. Olay hiç hafif değil, ciddi değil. Gerçekten ciddi.

Şöyle ki, Bu yüzden Florida’nın hamlesini sadece “OpenAI’ye kızdılar” diye okumak eksik ölür. Eyalet yönetimleri artık AI şirketlerinden şu sorunun cevabını istiyor: Modeliniz sadece çalışıyor mu, yoksa gerçekten kontrollü mü? Çünkü çalışan ama kontrolsüz sistemler — dürüst olmak gerekirse — üretim ortamında küçük çaplı felaket demek.

Durun, bir saniye.

Neden özellikle şimdi?

Şahsen, Zamanlama boşuna değil. ChatGPT benzeri araçlar artık kurumsal ekiplerden lise öğrencilerine kadar her yerde dolaşıyor; insanlar bunları not almak için de kullanıyor, kod yazmak için de, terapi benzeri konuşmalar için de. Hâliyle kamu otoritesi şunu soruyor: Bu kadar yaygınlaşmış bir araçta yaş sınırlaması nasıl uygulanacak? Zararlı içerik filtresi nerede devreye giriyor? Yanitlar net değilse baskı artıyor — bu kadar basit.

Bir de siyasi taraf var tabi. ABD’de eyaletler son yıllarda AI düzenlemesinde kendi yolunu çizmek istiyor; federal seviyedeki tartışmalar ağır ilerleyince Florida gibi eyaletler “biz beklemeyelim” moduna geçebiliyor. Bu da teknoloji şirketleri açısından pek rahatlatıcı bir tablo yaratmıyor. Daha fazla bilgi için Braves Booth’ta Sessiz Devrim: Ekran Sıkışınca Her Şey Değişiyor yazımıza bakabilirsiniz.

| Risk Alanı | Neyi Etkiler? | Sahadaki Olası Sonuç |

|---|---|---|

| Çocuk güvenliği | Erişim ve içerik denetimi | Zararlı tavsiye veya uygunsuz sohbet riski |

| Ulusal güvenlik | Kötüye kullanım senaryoları | Propaganda, oltalama ve manipülasyon |

| Veri gizliliği | Kullanıcı girdileri ve loglar | Duyarlı bilginin yanlış işlenmesi |

| Sorumluluk zinciri | Kimin neyi denetlediği | Hukukî belirsizlik ve itibar kaybı |

OpenAI neden hedefte?

Ne yalan söyleyeyim, Kısa cevap şu: çünkü hedef tahtasının üzerinde en görünür oyunculardan biri o (bizzat test ettim). Uzun cevap işe biraz can sıkıcı — sektörde büyük olan herkes artık otomatik olarak daha fazla sorgulanıyor (bu konuda ikircikliyim). OpenAI’nın ürünleri milyonlara dokunduğu için hata payı da büyüyor, beklenti de artıyor. Makul bir döngü aslında, sevilmese de (şaşırtıcı ama gerçek) AI ile Kurulan Uygulamalar Neden İşletmeleri Zorluyor? yazımızda bu konuya da değinmiştik.

Editör masasındayken geçen ay bununla ilgili ayrı bir haber okumuştum ve ilk tepkim şu olmuştu: “Bir şirket bu kadar hızlı büyürse devletler mutlaka kapıyı çalar.” Hele konu çocuklar olunca iş daha da hassaslaşıyor. Benim bakış açıma göre burada asıl mesele kötü niyet değil; ölçeklenmiş iyilik ile ölçeklenmiş risk arasındaki fark. Daha fazla bilgi için Bash Alias’ları: Az Yaz, Çok İş Gör yazımıza bakabilirsiniz.

Bazıları şöyle düşünüyor: Eğer model yararlıysa gerisini boş verelim. Ama pratik böyle işlemiyor. Küçük startup’ta kullanılan bir chatbot ile milyonlara açık platform aynı kefeye konmaz — kurumsal tarafta denetim katmanları kurarsınız, giriş-çıkış kayıtları tutulur, prompt filtreleri ölür, erişim rolleri tanımlanır. Tüketici ürününde işe işler çoğu zaman çok daha dağınık gider (ki bu çoğu kişinin gözünden kaçıyor) Bu konuyla ilgili Butterfly CSS: 2026’da Dikkat Çeken Hafif Bir Seçenek yazımıza da göz atmanızı tavsiye ederim.

Küçük ekipler ile dev platformların farkı

Küçük ekiplerde risk genelde dar alanda kalır. Hata varsa da etkisi sınırlı. Ama büyük platformlarda tek cümle bile dalga yaratıyor — bayağı sert dalga. O yüzden devlet kurumları doğal olarak büyük oyunculara odaklanıyor; sonuçları ölçmek kolay çünkü, hem hukukî hem toplumsal açıdan. Daha fazla bilgi için PDF Dünyasında Bir Nefes: Ücretsiz ve Limitsiz Araçlar yazımıza bakabilirsiniz.

Yapay zekâda en pahalı hata çoğu zaman teknik hata değildir; yanlış zamanda yapılan doğru şeydir.

Şimdi biraz daha somut tarafa gelelim. Eğer elinizde kullanıcıyla uzun süreli sohbet eden bir model varsa, onun ürettiği tonlama bile önem kazanıyor. Nazik görünür ama yönlendirici olabilir. Özgüvenli görünür ama yanlış bilgi verebilir. Dost canlısı görünür ama sınırları bulanıklaştırabilir. Hmm, “dostane” ile “manipülatif” arasındaki çizgi bazen o kadar ince ki…

Düzenleme mi geliyor, yoksa fren sesi mi?

Düzenleme korkusu bazen abartılıyor gibi anlatılıyor. Bazen de tam tersi yapılıyor — sanki hiçbir sorun yokmuş gibi davranılıyor. İkisi de sağlıklı değil. Gerçekçi tablo şu: Yapay zekâ regülasyonu artık lüks değil. Altyapının parçası olmak zorunda. Nokta.

Hani, Benzer tartışmayı Avrupa’da gördük; Amerika’da işe eyalet bazlı baskılar giderek belirginleşiyor. Bu durum teknoloji şirketlerine ekstra operasyon yükü bindiriyor — tek ürün için bile farklı hukuk yorumlarına göre ayrı politika setleri hazırlamak gerekiyor, hani bulut mimarisinde bölgesel yapı kurarsınız ya, burada da politika mimarisi kuruluyor aslında. Benzer karmaşıklık, çok daha az eğlenceli.

- Kayıt tutma: Kim ne sordu, model ne yanit verdi?

- Erişim sınırı: Yaş doğrulama nasıl yapılıyor?

- Zararlı içerik filtresi: Ne zaman tetikleniyor? (bence en önemlisi)

- Müdahale mekanizması: Şüpheli kullanımda hesap askıya alınıyor mu?

Sektör bunu nasıl okuyor?

Eh, Büyük teknoloji firmaları genelde şöyle savunma yapıyor: “Biz araç sağlıyoruz.” Evet ama dür bir saniye — araç dediğiniz şey artık mutfak bıçağı değil. Biraz matkap, biraz mikser, biraz da mikrofon gibi davranan hibrit bir şey olmuş durumda. Kullanıcı önü nerede kullanırsa sonuç oraya gidiyor.

Bence hayal kırıklığı yaratan nokta şu oldu: sektör uzun süre “önce büyüyelim sonra düzeltiriz” mantığıyla yürüdü. Bu yaklaşım internet çağında (söylemesi ayıp) belli ölçüde işledi ama AI çağında aynı reçete pek tat vermiyor. Zarar zinciri çok hızlı kuruluyor çünkü. E peki, sonuç ne oldu? Çok hızlı.

Kullanıcı tarafında ne değişir?

Peki sıradan kullanıcı bundan ne anlıyor? Şöyle düşünün — sabah kahvesini içerken ChatGPT’den ödev yardımından yemek tarifine kadar her şeyi isteyen biriyseniz bu soruşturma size uzak görünebilir ama aslında tam orta yerindesinizdir. Eğer düzenleyici baskı artarsa bazı özellikler sıkılaşabilir, yaş doğrulama gelebilir ya da belirli kullanım türlerinde ek uyarılar görebilirsiniz. Sınır bozucu mu? Olabilir. Ama kaçınılmaz.

Kurumlar açısından işe iş başka boyutta ilerliyor — ciddi anlamda başka boyutta (en azından benim deneyimim böyle). Mesela eğitim kurumları ve sağlık kuruluşları gibi alanlarda AI kullanım politikaları sertleşebilir. Küçük startup’lar için bu maliyet demek; enterprise tarafta işe uyum ekibi demek (evet, doğru duydunuz). Açıkçası bu farkın bütçeye yansıması az buz olmaz.

// Basit risk kontrol mantığı

if (user_age < 18) {

enable_strict_safety_mode();

block_sensitive_topics();

} else {

log_usage();

monitor_for_abuse();

}Bana kalırsa asıl soru şu…

“Yapay zekâ iyi mi kötü mü?” sorusu artık fazla yüzeysel kaldı. Gerçekten. Asıl soru şu olmalı: Bu sistemler hangi sınırlar içinde çalışacak ve o sınırları kim çizecek? Devlet mi? Şirket mi? Kullanıcı mı? Hepsi biraz karışık durumda ve açıkçası bugün hâlâ net cevap yok.

Editörlük yaptığım yıllarda teknoloji haberlerinde en çok gördüğüm şeylerden biri şu oldu: ilk anda küçük görünen regülasyon adımları birkaç yıl içinde sektör standardına dönüşüyor (ki bu çoğu kişinin gözünden kaçıyor). Bugün Florida’dan gelen inceleme haberi de yarın başka eyaletlere emsal olabilir. Nitekim bir arkadaşımın Austin’de kurduğu küçük SaaS girişimi geçen yıl veri politikalarını üç kez değiştirmek zorunda kaldığını anlatmıştı — sebep basitti, müşteri tarafındaki hukuk ekibi artık “AI nerede kullanılıyor?” diye tek tek soruyordu. Neyse uzatmayalım — bu sorunun yankısı bir süre daha devam edecek gibi görünüyor.

Sıkça Sorulan Sorular

Florida neden OpenAI hakkında inceleme başlattı?

Ana nedenler arasında ulusal güvenlik kaygıları. Çocukların ChatGPT gibi araçlarla etkileşiminde ortaya çıkabilecek riskler var.. Eyalet yönetimi özellikle zararlı içerik ve uygunsuz yönlendirme ihtimaline odaklanıyor..)

Bu inceleme kullanıcıları doğrudan etkiler mi?

Garip gelecek ama, Kısmen evet (ben de ilk duyduğumda şaşırmıştım). Kullandığınız hizmette yeni yaş doğrulama adımları ya da ekstra güvenlik uyarıları görebilirsiniz.. Bazı özellikler daha sıkı filtrelerle çalışabilir…

Sadece OpenAI mi mercek altında kalabilir?

İşin garibi, Hayır.. Böyle soruşturmalar genelde pek çok sektöre mesaj verir.. Yani bugün OpenAI konuşulur ama yarın başka büyük AI sağlayıcıları da benzer baskıyla karşılaşabilir..}

Küçük şirketler bundan nasıl etkilenir?

Küçük şirketlerde uyum maliyeti yükselir çünkü yeni politika yazmak ve denetim katmanı kurmak gerekir.. Yine de iyi taraf şu:, erken hareket eden startup’lar müşteriye daha fazla güven verebilir…

Kaynaklar ve İleri Okuma

Şunu söyleyeyim, OpenAI Resmî Bloğu

OpenAI Policies and Safety Guidelines

Florida State Government and Legal Resources

Bu içerik işinize yaradı mı?

Benzer içerikleri kaçırmamak için beni sosyal medyada takip edin.