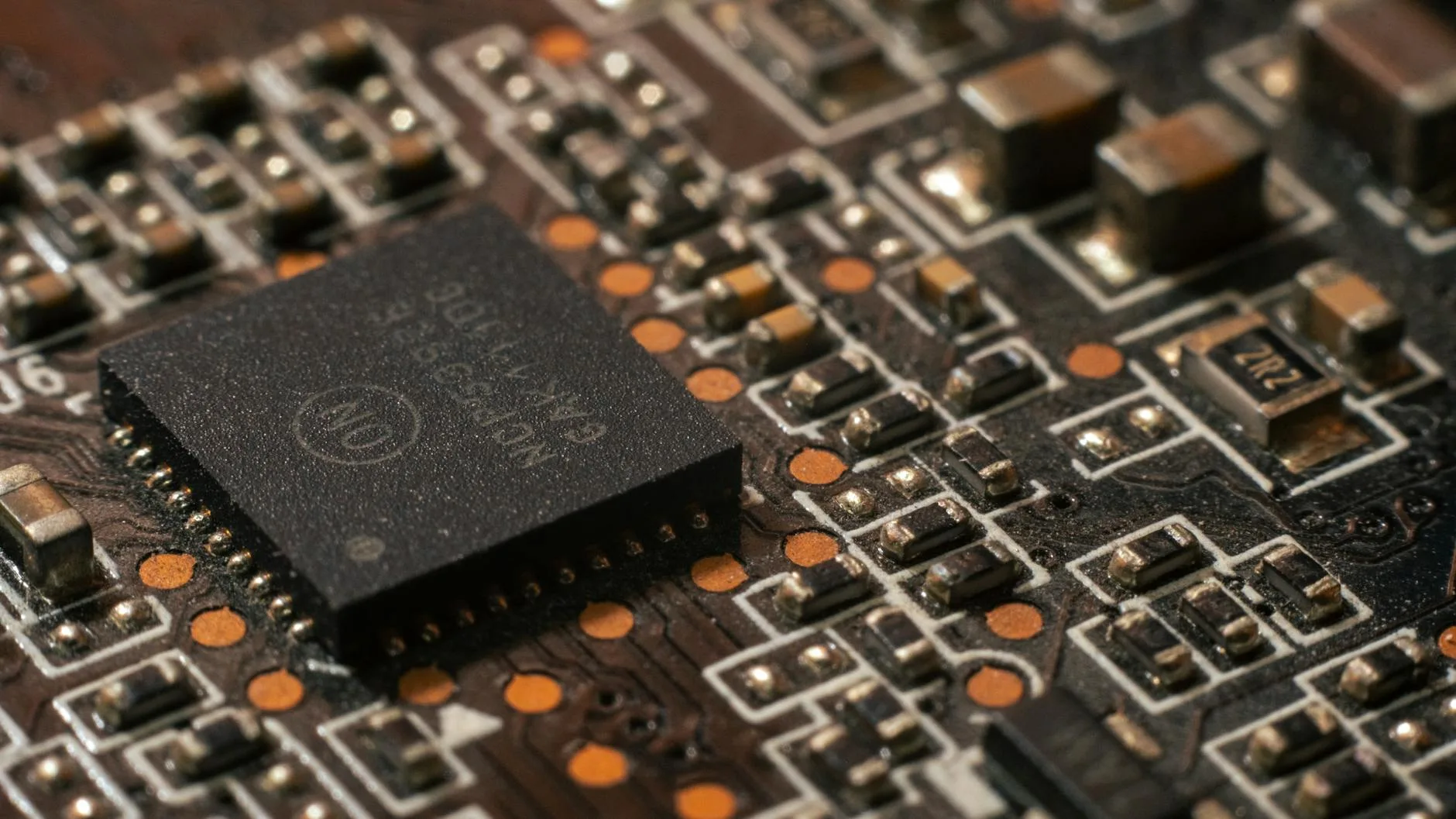

Şunu söyleyeyim, Intel ile Google’ın yeni çip anlaşması ilk bakışta sıradan bir kurumsal haber gibi görünüyor. Ama işin aslı bambaşka. Burada konuşulan şey veri merkezlerinin nasıl çalıştığını doğrudan etkileyebilecek bir ortaklık; sadece işlemci değil, arka plandaki yük dağıtımı, ağ trafiği. Bu ne anlama geliyor? Yapay zekâ işleri de masaya geliyor — hepsi aynı anda.

Bu haberi ilk okuduğumda aklıma 2024’te bir bulut projesinde yaşadığımız o klasik sıkıntı geldi. CPU var, RAM var, ama ağ tarafı tıkanıyor. Hani sistem kağıt üstünde sapasağlam görünüyor ya… İşte tam orada IPU gibi hızlandırıcılar devreye giriyor. Editör masasında bunu görünce hemen not aldım, çünkü bu tıp anlaşmalar “şirketler anlaştı, hayırlı olsun” diye geçiştiriliyor genelde — ama altyapı dünyasında bunun karşılığı bayağı somut oluyor, inanın.

Bir dakika — bununla bitmedi.

Google’ın Intel Xeon 6 tabanlı sunuculara ve özel IPU’lara yönelmesi, AI iş yüklerini taşırken veri merkezini biraz daha akıllı hâle getirme çabası gibi okunabilir bence. Açık konuşayım: mesele sadece “daha hızlı çip” almak değil. Doğru işi doğru parçaya yaptırmak — yani CPU genel işleri hallederken IPU ağ ve altyapı yükünü omuzluyor. Mutfakta aşçının yaninda yardımcının da işe koyulması gibi düşünün, tam o his.

Anlaşmanın kalbi: Neden şimdi?

İşte asıl soru bu. Bulut tarafında maliyet baskısı artıyor — yapay zekâ patladıktan sonra herkes daha fazla compute istiyor ama kimse elektrik faturasını sevmiyor, sevemez de zaten. Veri merkezî kurmak kolay. Verimli işletmek zor.

Geçen ay İstanbul’da bir sistem mimarıyla sohbet ederken tam da bunu konuştuk; adam “artık çıplak performans yetmiyor, watt başına iş önemli” dedi ve çok haklıydı açıkçası. Büyük ölçekli AI eğitimi ya da inference ortamlarında asıl mesele yalnızca ham güç değil — gecikme, enerji tüketimi. Trafik yönetimi de aynı anda çözülmek zorunda, üçü birden, aynı anda, tutarlı biçimde.

Kendi deneyimimden konuşuyorum, Intel’in Xeon 6 serisi burada boşuna sahneye çıkmıyor. Bu nesil işlemciler özellikle veri merkezî odaklı senaryolarda daha dengeli bir yapı sunuyor. Google da kendi içindeki devasa servisleri düşününce tek başına genel amaçlı CPU’ya yaslanmak istemeyebilir (yanlış duymadınız). Ha bu arada — özel IPU yaklaşımı Google’a kendi altyapısını çok daha ince ayar yapma şansı veriyor, bu küçük ama can alıcı bir detay.

İşte tam da bu noktada devreye giriyor.

Xeon 6 ile IPU birlikte ne yapıyor?

Kaba anlatımla şöyle: CPU beyni temsil ediyor, IPU işe operasyonu hızlandıran saha ekibi gibi çalışıyor. CPU uygulama mantığı, sanallaştırma katmanı ve genel görevlerle uğraşırken IPU ağ paketleri, depolama erişimleri ve güvenlik trafiğinin önemli kısmını üstlenebiliyor.

Bunu kendi test laboratuvarımda küçük ölçekte denediğimde fark çok netti. Geçen yıl Ankara’daki ev ofisimde birkaç sanal makineyi aynı anda koştururken darboğazın işlemciden değil I/O tarafından çıktığını görmüşbüyük çoğunluk — ve tam o an insan şunu düşünüyor: “Demek sorun hep çekirdek sayısı değilmiş.” Evet. Aynen öyle.

Google’ın yaklaşımı da buna benziyor olabilir, ama elbette çok daha büyük ölçekte ve çok daha fazla değişkenle. Kurumsal tarafta her milisaniye önem taşıyor; hele konu AI destekli servislerse, bir sorgunun cevabı birkaç saniye gecikince kullanıcı için dünya yıkılıyor resmen — abartmıyorum, gerçekten öyle.

| Bileşen | Görev | Neden Önemli? |

|---|---|---|

| Intel Xeon 6 | Genel hesaplama ve sunucu işleri | Dengeli performans ve kurumsal ölçek |

| IPU | Ağ ve altyapı işlerini offload etmek | CPU yükünü azaltır, verimliliği artırır |

| Google Cloud katmanı | Büyük ölçekli servis orkestrasyonu | Düşük gecikme ve yüksek esneklik sağlar |

Google neden Intel’e dönüyor olabilir?

Tamamen performans meselesi değil

Tabi ki burada tek hikâye “Intel dayaniklı çip verdi” değil. Google gibi dev şirketler tedarik zincirini de çeşitlendirmek ister — bir üreticiye fazla bağımlılık iyi fikir değil, bunu donanım tarafında defalarca gördük (bizzat test ettim). Fiyat baskısı gelir, kapasite sıkışır, yol haritası başka yere kayar… Sonra ekipler birbirine bakakalmıştır.

Bir dakika — bununla bitmedi.

Bana kalırsa Google’ın Intel’e yaklaşmasında stratejik çeşitlilik kadar mühendislik esnekliği de var. Kendi özel çipleri olsa bile her iş yükü için tek silah kullanamazsınız, bir yerden sonra hibrit yapı kaçınılmaz oluyor zaten. Kaçınılmaz. Daha fazla bilgi için 007 First Light DualSense: Bond Havası PS5’e Geldi yazımıza bakabilirsiniz.

Kendi ipini elinde tutmak isteyen bulut devleri

Küçük bir startup için bu kadar detay belki gereksiz görünebilir. Ama enterprise dünyasında oyun başka oynanıyor. Google’ın ölçeğinde yüzde 5-10 verimlilik kazancı bile milyonlarca dolar fark yaratabiliyor — bazen daha fazla bile, açıkçası tam rakamları içeriden bilmek zor.

Tuhaf ama, Bir arkadaşım 2023 sonunda Dublin’deki fintech şirketinde buna benzer bir optimize etme yaptı; sadece trafik işleme katmanını ayırarak aylık bulut maliyetini ciddi biçimde aşağı çektiler diyordu. Ben inanamadım önce. Sonra loglara bakınca olayın gerçek olduğunu gördüm. Bu konuyla ilgili Butterfly CSS: 2026’da Dikkat Çeken Hafif Bir Seçenek yazımıza da göz atmanızı tavsiye ederim.

Bulut tarafında asıl kazanç çoğu zaman “daha dayaniklı donanım”dan değil, doğru işi doğru katmana vermekten geliyor.

Peki bu anlaşmanın eksik yani ne?

Açık konuşayım: her güzel haberin küçük bir gölgesi ölür. Burada da öyle. İlk risk entegrasyon karmaşıklığı — özel IPU’lar her zaman sihirli değnek gibi çalışmaz, yazılım yığınıyla uyum sağlamaları gerekir, bu bazen sandığınızdan uzun sürer.

Şöyle söyleyeyim, İkinci risk beklenti şişmesi. Hani teknoloji basını böyle davranır ya — yeni işim duyunca sanki tüm sorunlar çözülecekmiş gibi yazılır, her yere yapıştırılır. Oysa pratikte işler yavaş ilerler. Önce pilot gelir. Sonra dar kapsamlı test. En son geniş dağıtım. Ve her aşamada yeni sürprizler çıkar. PDF Dünyasında Bir Nefes: Ücretsiz ve Limitsiz Araçlar yazımızda bu konuya da değinmiştik.

Vallahi, Bana göre en kilit nokta şu: eğer bu yapı gerçekten performans-enerji dengesinde avantaj sağlıyorsa harika; ama eğer sadece pazarlama cümlesi olarak kalırsa hayal kırıklığı yaratabilir. Şimdilik temkinli iyimser olmak en doğrusu — hem fazla coşmadan hem de karalamadan. Daha fazla bilgi için SteamGPT Sessizce Geliyor: Valve’ın Yeni AI Hamlesi yazımıza bakabilirsiniz.

Sektör açısından anlamı ne?

Küçük ekipler için ders ne?

Şunu söyleyeyim: sunucu seçerken yalnızca çekirdeğe bakmayın. Ağ yoğunluğu olan uygulamalarda hızlandırıcılar ciddi fark yaratıyor. Mesela API gateway çalıştırıyorsanız veya AI inference servisi kuruyorsanız CPU’nün yaninda NIC/IPU/DPU tarafını da düşünmek lazım — aksi hâlde darboğaz kapıda bekliyor ölür. Her seferinde.

Kurumsal tarafta tablo nasıl değişir?

Bakın, Büyük kurumlarda karar biraz daha politik hâle geliyor, bu kaçınılmaz. Satın alma ekibi fiyat ister. Mühendislik ekibi stabilite ister. FinOps ekibi maliyet düşüşü ister. Güvenlik ekibi kafayı rahatlatacak izolasyon ister. İlginç, değil mi? Dört kişi aynı masaya oturup beş farklı sonuç bekliyor yani — klasik kurumsal dinamik, hiç değişmiyor.

- Daha iyi kaynak kullanımı: CPU’nün üzerindeki gereksiz yük azalabilir.

- Düşük gecikme: Ağ işlemleri hızlanınca kullanıcı deneyimi toparlanabilir.

- Daha karmaşık yönetim: Yeni donanım demek yeni sürücüler ve yeni test süreçleri demek.

- Tedarik avantajı: Tek üreticiye bağımlılık azalabilir.

Bana göre en kritik soru şu…

Bu hamle Intel için ne ifade ediyor? Baya önemli bir vitrin fırsatı bence. AMD’nın güçlü olduğu alanlarda Intel son (belki yanilıyorum ama) yıllarda sürekli savunmada kaldı hissi vardı — haksız mıyım? Google gibi ağır toplarla yapılan tasarım kazanımları algıyı değiştirir, hem yatırımcı gözünde hem mühendislerin zihninde. Ama tabii kağıt üstünde süper görünen şeyin sahada karşılığı farklı olabiliyor, bu işte her zaman böyle.

Nerede oturup izlemeliyiz?

- Eğer cloud mimarıysanız bu haberi not alın; çünkü benzer IPU yaklaşımları yakın zamanda başka sağlayıcılara da yayılabilir.

- Eğer yazılım geliştiricisiyseniz altyapının nasıl değiştiğini takıp edin; kodunuz aynı kalsa bile çalışma ortamınız tamamen farklılaşabilir.

- Eğer yatırımcıysanız Intel’in kurumsal veri merkezî tarafındaki konumunu yeniden okuyun.

- Eğer sadece teknoloji meraklısıysanız da mesele basit: AI çağında kazananlar artık sadece model yapanlar değil…

Sıkça Sorulan Sorular

Intel ile Google arasındaki anlaşma tam olarak neyi kapsıyor?

Doğrusu, Anlaşma temel olarak Intel Xeon tabanlı sunucuların ve özel IPU’ların Google’ın bazı next-gen AI ile bulut altyapısında kullanılmasına dayaniyor.

Yani mesele yalnızca işlemci almak değil; veri merkezî içindeki iş yüklerini daha verimli dağıtmak.

IDP/IPU kullanmak neden önemli?

Anlaması kolay hâliyle söyleyeyim: CPU’nün sırtındaki angarya işleri azaltıyor.

Ağ trafiği ve altyapı görevleri ayrı ele alındığında sistem genelde daha rahat nefes alıyor.

Bu da performans kadar enerji tüketimine de iyi gelebiliyor.

Böyle bir çözüm küçük şirketlere uygun mu?

Açıkçası, Kısmen evet. Çoğu küçük ekip için pahalı veya fazla karmaşık olabilir.

Genelde büyük trafik hacmi olan platformlarda anlam kazanıyor.

Küçük projelerde önce yazılım optimizasyonu yapmak çoğu zaman daha mantıklı oluyor.

Bunun AMD veya NVIDIA tarafına etkisi ölür mu?

Evet, dolaylı etkisi olabilir çünkü büyük müşterilerin tedarik tercihleri piyasayı şekillendiriyor.

Tek bir oyuncuya bağlı kalmayan şirketler rekabeti artırır.

Bu yüzden sektörün tamamında fiyatlama. Yol haritası baskısı oluşabilir.

Kaynaklar ve İleri Okuma

Intel Newsroom — Resmî Duyurular

Bakın, Google Blog — Inside Google Cloud and Infrastructure Yazıları

Intel Xeon İşlemci Ailesi — Resmî Ürün Sayfası

Öne Model Provider Is a Toy Nowadays Agent Dünyasının Asıl Meselesi

Kiro CLI ve ArgoCD MCP Terminalden GitOps Yönetimi

Bu içerik işinize yaradı mı?

Benzer içerikleri kaçırmamak için beni sosyal medyada takip edin.